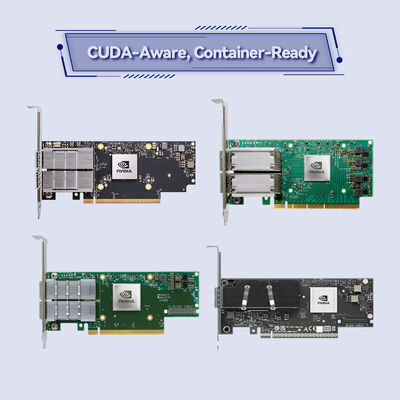

NVIDIA ConnectX-7 Adaptateur VPI Dual-Port NDR 400 Gb/s, PCIe 5.0, GPUDirect, RoCE ¥ MCX75310AAS-NEAT

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX75310AAS-NEAT (900-9x766-003N-SQ0) |

| Document: | Connectx-7 infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Numéro de modèle.: | MCX75310AAS-NEAT (900-9x766-003N-SQ0) | Ports: | Port unique |

|---|---|---|---|

| Technologie: | Infiniband | Type d'interface: | OSFP56 |

| Spécification: | 16,7 cm x 6,9 cm | Origine: | Inde / Israël / Chine |

| taux de transmission: | 400 gbe | Interface hôte: | Gen3 x16 |

| Mettre en évidence: | Adaptateur réseau NVIDIA ConnectX-7,Carte PCIe à double port NDR de 400 Gb/s,Adaptateur direct de Mellanox RoCE |

||

Description de produit

MCX755106AS‑HEAT | NIC intelligente double port PCIe 5.0

Accélérez les charges de travail d'IA, de calcul scientifique et de cloud d'entreprise avec la famille NVIDIA ConnectX-7. Le MCX755106AS-HEAT offre jusqu'à200 Gb/s InfiniBand (HDR)et une flexibilité Ethernet 200 GbE, des moteurs de calcul en réseau, une sécurité au niveau matériel et une latence ultra-faible — le tout alimenté par PCIe 5.0.

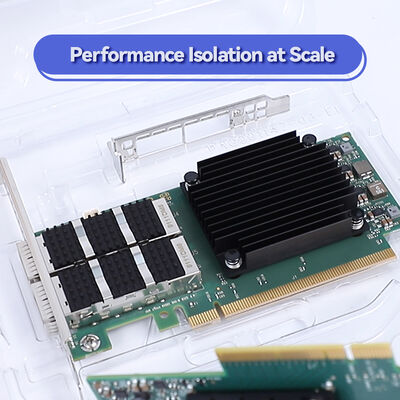

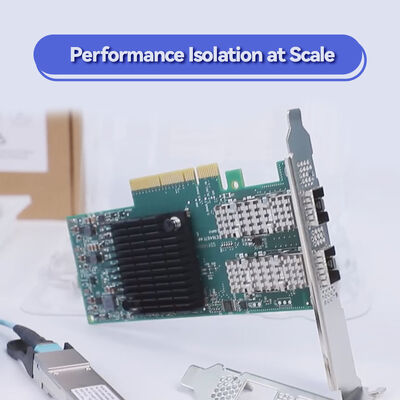

L'adaptateur NVIDIA ConnectX-7 VPI MCX755106AS-HEAT est une carte d'interface réseau intelligente double port de 200 Gb/s conçue pour les clusters de calcul haute performance (HPC), les usines d'IA et les centres de données d'entreprise. Combinant la prise en charge des protocoles InfiniBand et Ethernet, il permet l'accès direct à la mémoire à distance (RDMA), GPUDirect Storage et des moteurs de calcul en réseau avancés tels que SHARPv3 et le déchargement de la fusion. Avec une interface hôte PCIe 5.0 et des accélérateurs de sécurité matériels, cet adaptateur décharge le processeur, réduit le coût total de possession et offre des performances constantes à faible latence.

Idéale pour les organisations qui modernisent leur infrastructure informatique, du bord au cœur, la famille ConnectX-7 apporte une mise en réseau, un stockage et une sécurité définis par logiciel et accélérés par matériel — permettant des solutions évolutives et sécurisées avec une surcharge minimale.

ConnectX-7 intègre la technologie NVIDIA ASAP² (Accelerated Switch and Packet Processing) pour offrir une mise en réseau définie par logiciel à la vitesse de la ligne sans consommer de cœurs CPU. Des moteurs matériels en ligne gèrent le chiffrement/déchiffrement pour IPsec, TLS et MACsec, protégeant les données en mouvement du bord au cœur. Pour le stockage, le déchargement NVMe-oF intégré et GPUDirect Storage permettent le mouvement direct des données entre la mémoire de stockage et la mémoire GPU, réduisant la latence et maximisant le débit. L'adaptateur prend également en charge la synchronisation horaire avancée (PTP avec une précision de 12 ns) et la pagination à la demande (ODP) pour le RDMA sans enregistrement, ce qui le rend idéal pour les architectures désagrégées et centrées sur la mémoire.

- Clusters d'IA et de grands modèles linguistiques (LLM) : Interconnexion à haut débit pour les serveurs GPU, exploitant GPUDirect RDMA et les déchargements collectifs SHARP.

- Calcul haute performance (HPC) : Fabric InfiniBand HDR 200 Gb/s pour MPI, OpenSHMEM et simulations scientifiques.

- Cloud hyperscale et centres de données SDN : RoCEv2, accélération de superposition et SR-IOV pour la virtualisation multi-locataire.

- Passerelle de sécurité d'entreprise : Chiffrement MACsec/IPsec en ligne pour les communications du bord au cœur avec déchargement matériel.

- Systèmes de stockage : Déchargement NVMe-oF/TCP, plateformes de stockage distribuées nécessitant une latence ultra-faible et des IOPS élevés.

✅ Systèmes d'exploitation : Pilotes intégrés pour Linux (RHEL, Ubuntu), Windows Server, VMware ESXi (SR-IOV), Kubernetes (plugins CNI).

✅ Protocoles : InfiniBand (HDR/EDR), Ethernet (200 GbE à 10 GbE), RoCE, RoCEv2, iSCSI, NVMe-oF, SRP, iSER, NFS sur RDMA, SMB Direct.

✅ Middleware HPC : NVIDIA HPC-X, UCX, UCC, NCCL, OpenMPI, MVAPICH, MPICH, OpenSHMEM.

✅ Gestion : NC-SI, MCTP sur PCIe/SMBus, PLDM, Redfish, SPDM, mise à jour sécurisée du firmware.

| Spécification | Détails |

|---|---|

| Modèle de produit | MCX755106AS-HEAT (NVIDIA ConnectX-7 VPI) |

| Vitesse maximale | InfiniBand HDR 200 Gb/s ; Ethernet jusqu'à 200 GbE |

| Configuration des ports | Double port (prend en charge les variantes 1/2 port, ce modèle double port QSFP56) |

| Interface hôte | PCIe 5.0 x16 (jusqu'à x32 voies avec bifurcation / Multi-Host) |

| Facteur de forme | PCIe HHHL (Half Height Half Length) – support standard |

| Prise en charge des protocoles | InfiniBand (HDR/EDR) et Ethernet (200 GbE/100 GbE/50 GbE/25 GbE/10 GbE) |

| RDMA | RoCE, RoCEv2, transport fiable matériel, DCT, XRC, pagination à la demande (ODP) |

| Déchargement de sécurité | IPsec/TLS/MACsec en ligne (AES-GCM 128/256 bits), démarrage sécurisé, chiffrement Flash, authentification de périphérique |

| Déchargement de stockage | NVMe-oF (TCP/Fabrics), NVMe/TCP, T10-DIF, XTS-AES 256/512 bits au niveau du bloc |

| Synchronisation et horodatage | IEEE 1588v2 (PTP), précision de 12 ns, SyncE (G.8262.1), PPS configurable, planification déclenchée par l'heure |

| Virtualisation | SR-IOV, accélération VirtIO, déchargement de superposition (VXLAN, GENEVE, NVGRE) |

| Fonctionnalités avancées | GPUDirect RDMA, GPUDirect Storage, déchargement SHARP, routage adaptatif, déchargement de tampon de rafale |

| Gestion et démarrage | UEFI, PXE, démarrage iSCSI, démarrage InfiniBand à distance, PLDM, Redfish, SPDM, MCTP |

*Les spécifications sont basées sur la documentation publique de NVIDIA. Vérifiez la configuration exacte pour votre système avant de commander.

| Modèle | Ports / Vitesse | Interface hôte | Cible clé |

|---|---|---|---|

| MCX755106AS-HEAT | 2 ports InfiniBand HDR 200 Gb/s / 200 GbE | PCIe 5.0 x16 | Clusters d'IA, HPC, centres de données d'entreprise |

| MCX75310AAS-NEAT | 2 ports InfiniBand NDR 400 Gb/s | PCIe 5.0 x16 | IA haut de gamme, HPC à grande échelle |

| Variantes OCP 3.0 | SFF / TSF avec HDR/NDR | PCIe Gen5 | Serveurs Open Compute Project |

- Latence ultra-faible et débit élevé : Le RDMA matériel et le calcul en réseau minimisent la latence des queues d'application.

- Fabric unifié : Un adaptateur prend en charge InfiniBand et Ethernet, simplifiant l'inventaire et le déploiement.

- PCIe 5.0 pérenne : 32 GT/s par voie, double bande passante de PCIe 4.0, éliminant les goulots d'étranglement des E/S.

- Coût total de possession réduit : Décharge le CPU des tâches de mise en réseau, de stockage et de sécurité, permettant une utilisation plus efficace des serveurs.

- Optimisé pour l'IA : GPUDirect natif et opérations collectives SHARPv3 accélèrent l'entraînement et l'inférence des modèles.

Hong Kong Starsurge Group Co., Limited fournit une assistance de bout en bout, y compris des conseils avant-vente, une configuration personnalisée du firmware et une expédition mondiale. Tous les adaptateurs ConnectX-7 sont couverts par une garantie d'un an (extensible) et une assistance technique d'ingénieurs réseau expérimentés. Nous offrons un support multilingue, des services RMA et une logistique de remplacement rapide pour minimiser les temps d'arrêt.

- Assurez-vous que le slot PCIe fournit suffisamment d'alimentation (75W via le slot, aucune alimentation auxiliaire requise pour un fonctionnement normal).

- Vérifiez l'espace physique : le facteur de forme HHHL s'adapte à la plupart des serveurs 1U/2U ; les variantes OCP nécessitent un slot mezzanine correspondant.

- Pour le déploiement RoCE, configurez DCB (Priority Flow Control) et ECN sur les commutateurs pour un Ethernet sans perte.

- Mettez toujours à jour le firmware vers la dernière version stable pour bénéficier des améliorations de sécurité et de performance.

Fondé en 2008, Hong Kong Starsurge Group Co., Limited est un fournisseur axé sur la technologie de matériel réseau, de services informatiques et de solutions d'intégration de systèmes. Nous servons des clients dans le monde entier avec des produits tels que des commutateurs réseau, des NIC, des points d'accès sans fil, des contrôleurs, des câbles et des équipements réseau. Notre équipe commerciale et technique expérimentée soutient des industries telles que le gouvernement, la santé, la fabrication, l'éducation, la finance et les entreprises. Avec une approche axée sur le client, Starsurge se concentre sur la qualité fiable, le service réactif et les solutions sur mesure — aidant les clients à construire une infrastructure réseau efficace, évolutive et fiable.

Nous fournissons des solutions IoT, des systèmes de gestion de réseau, le développement de logiciels personnalisés, un support multilingue et une livraison mondiale. Choisissez Starsurge comme votre partenaire de confiance pour les solutions réseau NVIDIA.