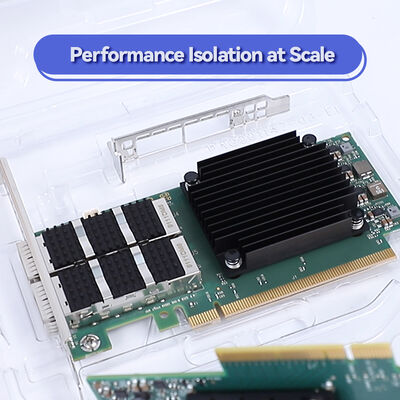

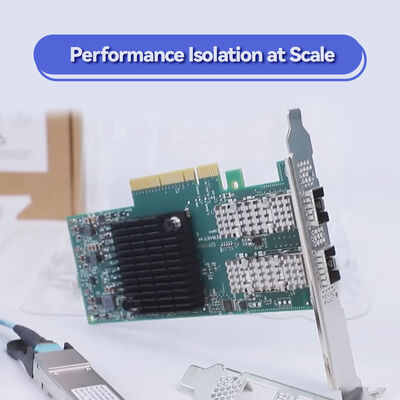

NVIDIA ConnectX-8 SuperNIC C8180 (900-9X81E-00EX-ST0) Adaptateur réseau IA 800G

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | C8180 (900-9x81e-00Ex-st0) |

| Document: | connectx-datasheet-connectx...1).pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Numéro de modèle.: | C8180 (900-9x81e-00Ex-st0) | taux de transmission: | 400 gbe |

|---|---|---|---|

| Ports: | Double port | Fonction: | LACP, support empilable, VLAN |

| Technologie: | Infiniband | Interface hôte: | Gen6 x16 |

| Type d'interface: | QSFP112 | Marque déposée: | Millanox |

Description de produit

Optimisé pour les charges de travail d'IA hyperscale, le ConnectX-8 SuperNIC offre une bande passante bidirectionnelle allant jusqu'à 800 Gb / s, une interface hôte PCIe Gen6 et un contrôle de congestion basé sur la télémétrie avancée.Construit pour les tissus InfiniBand et Ethernet, il alimente le calcul du GPU de trillions de paramètres et les applications d'IA agent avec une efficacité sans précédent.

Le NVIDIA ConnectX-8 SuperNIC (C8180) représente un saut générationnel dans l'accélération des tissus d'IA. Prenant en charge jusqu'à 800 gigabits par seconde (Gb/s) sur InfiniBand ou Ethernet,Cet adaptateur élimine les goulots d'étranglement du réseau dans les grappes GPU à grande échelleAvec PCIe Gen6 natif (jusqu'à 48 voies) et des fonctionnalités avancées telles que NVIDIA GPUDirect RDMA, SHARP en réseau et contrôle de congestion programmable,le ConnectX-8 assure un débit maximal et une latence minimale pour la formationSa conception économe en énergie s'aligne sur les objectifs de centres de données d'IA durables tout en permettant une mise à l'échelle au-delà de centaines de milliers de GPU.

- Largeur de bande totale de 800 Gb/sIl prend en charge les vitesses InfiniBand 800/400/200/100 Gb/s et Ethernet 400/200/100/50/25 Gb/s.

- Interface hôte PCIe Gen6- jusqu'à 48 voies, faible surcoût et prise en charge multi-hôtes pour jusqu'à quatre hôtes.

- L'informatique en réseauSHARPv3 pour les opérations collectives, les accélérations MPI, les décharges du protocole de rendez-vous.

- GPUDirect RDMA et stockageL'accès direct à la mémoire GPU et le stockage GPUDirect pour une entrée/sortie sans copie.

- Contrôle avancé de la congestion et télémétrieOptimisation du flux en temps réel pour la latence de la queue de l'IA.

- Sécurité du matérielLe démarrage sécurisé, le cryptage flash, l'attestation de l'appareil (SPDM 1.1), le cryptage intégré (IPsec/MACsec/PSP).

- Accélération RDMA et RoCEv2 avec contrôle de congestion programmable.

- Ethernet Accelerated Switching and Packet Processing (ASAP2) pour le déchargement SDN/OVS.

- Accélération du réseau de superposition: VXLAN, GENEVE, NVGRE.

- Les décharges TCP sans état (LSO, LRO, GRO, TSS, RSS).

- Protocole de temps de précision (PTP) IEEE 1588v2 Classe C, SyncE, PTM, planification déclenchée par le temps.

- Décharges du tampon, ré-ordre des paquets à grande vitesse.

Le ConnectX-8 SuperNIC C8180 est spécialement conçu pour les tissus d'IA de nouvelle génération et les environnements de cloud hyperscale:

- Les usines d'IA et les grands groupes de modèles linguistiques¢ formation des modèles de paramètres de trillions avec les réseaux 800G front-end et back-end.

- L'informatique haute performance (HPC)La réduction SHARPv3 dans le réseau accélère les collectifs MPI pour les simulations scientifiques.

- Centres de données en nuage accélérés par GPUL'isolation multi-locataire, les décharges superposées et le QoS avancé.

- Infrastructure de l'IA dans l'entreprise¢ des fermes d'inférence aux plates-formes de données d'IA nécessitant une faible latence déterministe.

- Stocks et tissus convergés¢ GPUDirect Storage et RoCEv2 pour NVMe-oF et les systèmes de fichiers distribués.

Intégration transparente avec les plateformes réseau NVIDIA et les principaux équipementiers de serveurs.

- NVIDIA NCCL, HPC-X, DOCA UCC/UCCX ont été créés par des sociétés de fabrication.

- L'indicateur MPI est ouvert, MVAPICH2

- Distributions Linux (RHEL, Ubuntu et SLES)

- Windows Server avec prise en charge RDMA

- DPDK et VPP pour les télécommunications et les VNF

- Systèmes NVIDIA DGX / HGX

- Serveurs compatibles avec PCIe Gen6 (nœuds accélérés x86 / Arm / GPU)

- Conception de la norme industrielle OCP 3.0 TSFF et de la conception de la mézanine

- Compatible avec les optiques 800G OSFP et 400G QSFP112

| Paramètre | Détails |

|---|---|

| Modèle de produit | Le montant de la garantie est calculé en fonction de l'indicateur d'indicateur. |

| Largeur de bande maximale | 800 Gb/s |

| Vitesses de bande Infini | Pour les appareils de traitement de l'air |

| Vitesses Ethernet | Les données sont fournies par le système d'exploitation. |

| Interface de l'hôte | PCIe Gen6 (jusqu'à 48 voies), multi-hôtes (jusqu'à 4 hôtes) |

| Facteurs de forme | Les données de l'établissement doivent être fournies à l'autorité compétente de l'État membre où l'établissement est situé. |

| Configuration du port | 1x 800G OSFP ou 2x 400G / divisé jusqu'à 8 ports logiques |

| Soutien RDMA | Résultats de la vérification de la conformité |

| Unité de mesure | 256 à 4096 octets, 1 Go de messages |

| Caractéristiques de sécurité | Démarrage sécurisé (hardware root de confiance), cryptage flash, SPDM 1.1, IPsec/MACsec/PSP en ligne |

| Temps et synchronisation | PTP IEEE 1588v2 classe C, synchronisation G.8262.1, PTM, PPS entrée/sortie |

| La gestion | Le système d'exploitation de l'appareil doit être conforme à la norme EN ISO/IEC 17025 et à la norme EN ISO/IEC 17025 et à la norme EN ISO/IEC 17025 |

| Démarrage du réseau | Pour les systèmes d'exploitation, les données sont fournies par les fournisseurs de services. |

| SKU / Option | Port / Vitesse | Facteur de forme | Cas d'utilisation typique |

|---|---|---|---|

| Le montant de l'impôt sur les sociétés est calculé à partir de l'impôt sur les sociétés. | 1x OSFP 800G (ou divisé en 2x400G / 8x100G) | Le PCIe HHHL | Les nœuds de formation de l'IA, les serveurs GPU à haute densité |

| Dual ConnectX-8 Mezzanine | Pour les appareils de traitement des déchets | Mezzanine propriétaire | Systèmes intégrés NVIDIA HGX / OEM |

| Le nombre d'heures de travail est déterminé en fonction de l'heure de travail. | 1x OSFP 800G | OCP 3.0 SFF | Plateformes OCP optimisées pour le cloud |

| Le PCIe HHHL 2P | Pour les appareils de traitement des déchets | Le PCIe HHHL | D'une haute disponibilité à deux ports ou à plusieurs tissus |

La vitesse de ligne de 800 Gbps et la gestion avancée de la congestion éliminent la variabilité des performances dans les nuages d'IA multi-locataires.Le temps de fonctionnement collectif diminue considérablement.

Le PCIe Gen6 et la prise en charge de l'InfiniBand et de l'Ethernet assurent une protection des investissements pour les architectures GPU de nouvelle génération.

La confiance dans le matériel, les mises à jour sécurisées du micrologiciel et le contrôle des flux basé sur la télémétrie donnent aux opérateurs confiance dans les usines d'IA de production.

Intégré nativement avec les technologies NCCL, DOCA et GPUDirect. Réduire le temps de solution pour les chercheurs en IA et les scientifiques des données.

En tant que partenaire de canal autorisé, Starsurge fournit une logistique mondiale, un conseil technique avant vente et un support après-vente pour NVIDIA ConnectX-8 SuperNIC.

- Test d'intégration avec votre environnement serveur/stockage.

- Gestion du micrologiciel et validation de la compatibilité.

- RMA et options de remplacement anticipé.

- Le câblage et le regroupement des émetteurs-récepteurs personnalisés (OSFP, QSFP112, câbles de rupture).

- Assistance technique multilingue (anglais, chinois, etc.).

- S'assurer d'un débit d'air et d'un refroidissement adéquats dans le châssis de serveur à haute densité lors de l'utilisation d'optiques 800G (déperdition de puissance typique de 25 à 30 W).

- Utilisez toujours des modules optiques / cuivre certifiés OSFP ou QSFP112 de NVIDIA ou de partenaires validés pour garantir l'intégrité du signal.

- Les mises à jour du micrologiciel doivent suivre les notes de sortie de NVIDIA; les versions de micrologiciel non prises en charge peuvent entraîner une dégradation des performances.

- La configuration multi-hôtes nécessite une prise en charge de bifurcation de fente PCIe spécifique de la carte mère. Veuillez vérifier auprès de votre fournisseur de serveur.

- Certaines fonctionnalités avancées (par exemple, SHARPv3, PTP Classe C) nécessitent une infrastructure de commutateur correspondante (familles NVIDIA Quantum-3 ou Spectrum-5).

Hong Kong Starsurge Group Co., Limited est un fournisseur technologique de matériel réseau, de services informatiques et de solutions d'intégration de systèmes.la société dessert des clients dans le monde entier avec des produits incluant des commutateurs réseau, NIC, points d'accès sans fil, contrôleurs, câbles et équipements de réseau connexes.le secteur manufacturierLa société propose également des solutions IoT, des systèmes de gestion de réseau, le développement de logiciels personnalisés, le support multilingue et la livraison mondiale.Avec une approche axée sur le client, Starsurge se concentre sur une qualité fiable, un service réactif et des solutions sur mesure qui aident les clients à construire une infrastructure réseau efficace, évolutive et fiable.

Pour les prix, les échantillons ou les conseils d'intégration de NVIDIA ConnectX-8 SuperNIC C810, veuillez contacter nos spécialistes du réseau.

| Composant | Modèles recommandés / validés |

|---|---|

| Plateformes de commutation | NVIDIA Quantum-3 InfiniBand, Ethernet à spectre 5 (800G est disponible) |

| Transcepteurs optiques | NVIDIA OSFP 800G DR8 / 2xFR4, QSFP112 400G SR4 / DR4 est une plateforme utilisée par les fournisseurs de services de téléphonie mobile. |

| Serveurs GPU | NVIDIA DGX H100/H200, Supermicro GPU X13, PowerEdge XE9680, HPE Cray XD Il est fourni avec des fonctionnalités de compression et d'affichage. |

| Systèmes d'exploitation | Il est disponible sur Ubuntu 22.04/24.04, RHEL 9.x, Rocky Linux 9, Windows Server 2025 (RDMA) Il est également possible de télécharger le logiciel |

- ☐ Confirmer le type de fente PCIe (PCIe Gen6 x16 ou x32; pour la bande passante hôte 800G complète, au moins PCIe 6.0 x16 recommandé)

- ☐ Vérifiez le dégagement thermique et la direction du débit d'air dans votre châssis (évier passif ou ventilateur actif requis?)

- ☐ Veuillez choisir le facteur de forme correct: HHHL / OCP 3.0 / Mezzanine pour votre serveur.

- ☐ Sélectionnez les câbles/optiques compatibles: OSFP 800G ou QSFP112 2x400G selon la variante de port.

- ☐ Veiller à ce que le commutateur cible supporte la vitesse 800G et les protocoles requis (InfiniBand NDR ou Ethernet 800G).

- ☐ Vérifiez le support du pilote et du micrologiciel: version MLNX_OFED ou NVIDIA DOCA pour votre système d'exploitation.

Commutateur InfiniBand 800G à 64 ports pour les grappes GPU.

51.2 Tbps, tissu Ethernet optimisé par l'IA 800G.

Décharges de stockage et de sécurité pour les centres de données en nuage IA.

câbles optiques actifs en cuivre à courte portée pour l'interconnexion SuperNIC.

- Guide de réglage des performances de réseau NVIDIA pour les tissus IA

- Manuel d'installation des cartes d'adaptateur ConnectX-8 (disponible sur demande)

- RoCEv2 Meilleures pratiques en matière de maîtrise des embouteillages

- Comprendre la réduction en réseau de SHARPv3 pour les LLM