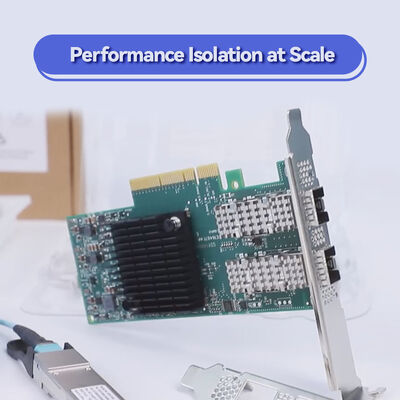

NVIDIA ConnectX-7 MCX75310AAS-NEAT NDR 400Gb/s Adaptateur InfiniBand

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX75310AAS-NEAT (900-9x766-003N-SQ0) |

| Document: | Connectx-7 infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Numéro de modèle.: | MCX75310AAS-NEAT (900-9x766-003N-SQ0) | Ports: | Port unique |

|---|---|---|---|

| Technologie: | Infiniband | Type d'interface: | OSFP56 |

| Spécification: | 16,7 cm x 6,9 cm | Origine: | Inde / Israël / Chine |

| taux de transmission: | 400 gbe | Interface hôte: | Gen3 x16 |

| Mettre en évidence: | Adaptateur InfiniBand NVIDIA ConnectX-7,Carte réseau Mellanox de 400 Gb/s,Adaptateur NDR InfiniBand avec garantie |

||

Description de produit

Le NVIDIA ConnectX-7 MCX75310AAS-NEAT est un adaptateur intelligent NDR 400Gb/s InfiniBand avec interface PCIe Gen5 x16 pour InfiniBand et RoCE.et les centres de données en nuage hyperscale, cet adaptateur ultra-faible latence intègre l'informatique en réseau, les décharges de sécurité matérielle,et la virtualisation avancée pour accélérer l'informatique scientifique moderne et les infrastructures définies par logiciel.

La famille NVIDIA ConnectX-7 offre des performances révolutionnaires avec une bande passante allant jusqu'à 400 Gb/s par port, prenant en charge à la fois InfiniBand (NDR/HDR/EDR) et Ethernet (jusqu'à 400 GbE).Le nombre d'équipements utilisés est déterminé en fonction de l'échantillon.Il dispose d'une interface hôte PCIe Gen5 (jusqu'à 32 voies), de la capacité multi-hôte et de moteurs avancés pour GPUDirect RDMA, l'accélération NVMe-oF et la cryptographie en ligne.simulation, et l'analyse en temps réel, cet adaptateur réduit les frais généraux du processeur tout en maximisant le débit et la sécurité des données.

Avec la mémoire embarquée pour la décharge de rendez-vous, l'accélération collective SHARP, et les décharges SDN ASAP2,ConnectX-7 transforme les serveurs standard en nœuds réseau haute performance avec une jitter proche de zéro et un chronométrage de précision de nanoseconde (IEEE 1588v2 Classe C).

- NDR InfiniBand et 400GbE prêts- Jusqu'à 400Gb/s de bande passante totale, prend en charge NDR, HDR, EDR InfiniBand et 400/200/100/50/25/10GbE

- Le système PCIe Gen5 x16 (jusqu'à 32 voies)- Interface hôte à haut débit avec indices de traitement TLP, ATS, PASID et SR-IOV

- L'informatique en réseau- Déchargement matériel des opérations collectives (SHARP), protocole de rendez-vous, déchargement de tampon de rupture

- GPUDirect RDMA et stockage GPUDirect- Piste de données directe GPU-NIC, accélérant l'apprentissage profond et l'analyse des données

- Moteurs de sécurité matériels- chiffrement/déchiffrement IPsec/TLS/MACsec en ligne (AES-GCM 128/256-bit) + démarrage sécurisé avec root-of-trust matériel

- Accélération de stockage avancée- NVMe-oF (sur les tissus/TCP), NVMe/TCP déchargement, T10-DIF transfert de signature, iSER, NFS sur RDMA

- ASAP2 SDN et accélération VirtIO- décharge OVS, encapsulation VXLAN/GENEVE/NVGRE, suivi des connexions et analyseur programmable

- Temps précis- PTP (IEEE 1588v2) avec une précision de 12ns, SyncE, planification déclenchée par le temps, rythme des paquets

Construit sur un processus de 7 nm, ConnectX-7 intègre plusieurs moteurs d'accélération matérielle qui déchargent le processeur et offrent des performances déterministes.

- RDMA sur Ethernet convergé (RoCE)- RoCE sans contact pour les tissus Ethernet à faible latence

- Transport dynamiquement connecté (DCT) et XRC- Une communication efficace entre MPI et HPC

- Paging à la demande (ODP) et enregistrement de la mémoire utilisateur (UMR)- Simplifie la gestion de la mémoire pour les applications à grande échelle

- Protocole d'agrégation et de réduction hiérarchique évolutive (SHARP)- Réduction des données en réseau pour les collectifs MPI

- Technologie à hôtes multiples- Permet à 4 hôtes indépendants de partager un seul adaptateur, optimisant l'utilisation du serveur

- La gestion du PLDM et du SPDM- Mise à jour du firmware, surveillance et attestation des appareils pour la sécurité de l'entreprise

- Clusters d'IA et d'apprentissage automatique- Formation à grande échelle avec NCCL, UCX et GPUDirect RDMA

- Simulation et recherche en HPC- Modélisation météorologique, génomique, dynamique moléculaire nécessitant un MPI à faible latence

- Cloud hyperscale et SDDC- Réseaux superposés, accélération NFV, multi-location sécurisée (SR-IOV)

- Systèmes de stockage d'entreprise- NVMe-oF cible le déchargement et les systèmes de fichiers distribués (Lustre, GPUDirect Storage)

- 5G Edge et télécommunications- Infrastructures sensibles au temps avec PTP de classe C et sécurité MACsec

Systèmes d'exploitation et virtualisation:Les pilotes intégrés pour Linux (RHEL, Ubuntu, Rocky Linux), Windows Server, VMware ESXi (SR-IOV) et Kubernetes (plugins CNI) ont été optimisés pour NVIDIA HPC-X, UCX, OpenMPI, MVAPICH,et UCC.

Compatibilité matérielle:Les emplacements PCIe Gen5 standard (x16 mécanique, x16/x32 électrique) sont certifiés avec les principales plateformes de serveurs des systèmes HPE, Supermicro et NVIDIA DGX.

Interopérabilité:Entièrement conforme à la spécification 1 de l'InfiniBand Trade Association.5, IEEE 802.3 pour Ethernet, et les spécifications PCI-SIG Gen5.

| Paramètre | Détails |

|---|---|

| Modèle de produit | Le nombre d'équipements utilisés est déterminé en fonction de l'échantillon. |

| Facteur de forme | PCIe HHHL (moitié de hauteur, moitié de longueur), comprenant le support FHHL |

| Interface de l'hôte | PCIe Gen5.0 x16 (jusqu'à 32 voies, prenant en charge la bifurcation et le multi-hôte) |

| Protocoles de réseau | Les équipements utilisés pour les réseaux électroniques sont les suivants: |

| Configuration du port | QSFP-DD à port unique (supporte 1x 400G NDR ou 2x 200G split; veuillez confirmer la densité de port par SKU) |

| Vitesses de bande Infini | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s, FDR (compatible) |

| Vitesses Ethernet | Le système de fréquence de fréquence NRZ/PAM4 est utilisé pour les fréquences de fréquence NRZ/PAM4. |

| Mémoire intégrée | Mémoire intégrée dans le réseau pour la décharge de rendez-vous et le tampon de rupture |

| Décharges de sécurité | L'utilisation de l'unité de mesure de sécurité est également autorisée. |

| Décharges de stockage | Le système de gestion de l'information est basé sur le système de gestion de l'information. |

| Temps et synchronisation | IEEE 1588v2 PTP (12ns de précision), SyncE, PPS programmable, planification déclenchée par le temps |

| Virtualisation | L'accélération de la connexion doit être effectuée en tenant compte de l'évolution de la fréquence d'accélération. |

| Gestionnabilité | Le système d'exploitation de l'appareil doit être équipé d'un système d'exploitation de l'appareil, qui doit être équipé d'un système d'exploitation de l'appareil. |

| Démarrage à distance | Le démarrage InfiniBand, iSCSI, UEFI, PXE |

| Consommation d'électricité | Pas spécifié publiquement - les adaptateurs de haute performance typiques nécessitent un débit d'air adéquat; veuillez confirmer avant de commander |

| Température de fonctionnement | 0°C à 55°C (avec refroidissement approprié du châssis) |

| Modèle (partiel) | Port/vitesse | Interface de l'hôte | Facteur de forme | Cas d' utilisation |

|---|---|---|---|---|

| Le nombre d'équipements utilisés est déterminé en fonction de l'échantillon. | 1x NDR 400Gb/s InfiniBand/Ethernet | Le système de contrôle de la qualité de l'air | HHHL | IA, HPC, Cloud - phare avec multi-hôte et démarrage sécurisé |

| Le nombre de points de contrôle doit être le même que le nombre de points de contrôle de l'appareil. | 1x NDR 400 Gb/s | Le système de contrôle de la qualité de l'air | HHHL | Un ensemble de fonctionnalités similaires avec crypto activé |

| Le nombre d'émissions de CO2 est déterminé par la méthode suivante: | 2x NDR 200 Gbps ou 1x 400 Gbps | Le système de contrôle de la qualité de l'air | FHHL | Deux ports pour la redondance |

| Variante OCP 3.0 | Jusqu'à 2x 200 Gb/s | Le système de contrôle de la qualité de l'air | OCP 3.0 SFF | Plateformes OCP hyperscale |

Pour les codes de commande exacts et les configurations personnalisées, veuillez consulter le manuel officiel de l'adaptateur ConnectX-7 PCIe (docs.nvidia.com) ou contacter Hong Kong Starsurge Group.

Coût total de possession le plus bas- Décharge le processeur des tâches de réseau, stockage et sécurité - réduisant les coûts de puissance et de refroidissement par Gb/s.

Largeur de bande prête pour le futur- Le support PCIe Gen5 et NDR 400G élimine les goulots d'étranglement pour les serveurs GPU de nouvelle génération et les clusters d'IA.

Sécurité des entreprises- le chiffrement en ligne du matériel (IPsec/TLS/MACsec) et la chaîne de confiance sécurisée sont conformes (FIPS, DoD).

Une intégration transparente- Compatibilité complète avec les principales distributions, hyperviseurs et plateformes d'orchestration de conteneurs.

Le groupe Starsurge de Hong Kong fournit un support de bout en bout du cycle de vie: conseils d'architecture avant vente, validation de la compatibilité, gestion de la garantie et services RMA.Notre équipe technique assiste au réglage du pilote.La garantie standard: support matériel limité de 3 ans avec une couverture étendue en option.

- S'assurer que la carte mère du serveur fournit une fente PCIe Gen5 avec un refroidissement adéquat (circulation d'air active recommandée pour le fonctionnement 400G)

- Pour les configurations multi-hôtes, vérifier les exigences en matière de support de plateforme et de câblage (des câbles de séparation peuvent être nécessaires)

- Les modules optiques / câbles DAC sont vendus séparément; utiliser des émetteurs-récepteurs NVIDIA-qualifiés pour la conformité

- Consommation d'énergie maximale non publiée par NVIDIA; la conception thermique typique suppose une plage de 25W-30W sous lourde charge, veuillez vérifier avec votre guide thermique du châssis

- Pour les fonctionnalités cryptographiques (offload IPsec/TLS), une licence supplémentaire peut être requise; veuillez confirmer auprès des ventes

Fondée en 2008, Starsurge est un fournisseur technologique de matériel réseau, de services informatiques et d'intégration de systèmes.et développement de logiciels personnalisésSoutenu par des équipes de vente et techniques expérimentées, Starsurge soutient les secteurs gouvernemental, de la santé, des finances, de la fabrication, de l'éducation et des entreprises.Notre approche axée sur le client garantit une qualité fiable, une logistique réactive et des solutions d'infrastructure sur mesure dans le monde entier.

En tant que partenaire autorisé des principales marques de réseautage, Starsurge offre un conseil professionnel avant vente, une livraison mondiale et un support multilingue pour vous aider à créer des réseaux évolutifs et efficaces.

- Le débit maximal:400 Gb/s par port

- Le PCIe Gen5:Jusqu'à 32 GT/s

- Soutien RDMA:InfiniBand et RoCE

- Sécurité:Le système IPsec/TLS/MACsec en ligne

- NVIDIA SHARP:Aggrégation au sein du réseau

- GPUDirect:RDMA + stockage

| Composant / écosystème | Soutenue | Les notes |

|---|---|---|

| NVIDIA DGX H100 / GH200 | - Oui, oui. | Certifié |

| VMware vSphere ou ESXi | Oui (SR-IOV) | Appui au conducteur inclus |

| Le noyau Linux 5.x+ | Oui (en boîte) | Recommandé par MLNX_OFED |

| Le serveur Windows 2022 | - Oui, oui. | RDMA / RoCE native |

| Le groupe Kubernetes / CNI | - Oui, oui. | Le nombre de personnes concernées par les mesures de prévention |

| OpenMPI ou MVAPICH | - Oui, oui. | Optimisé pour les verbes InfiniBand |

- Vérifiez la plateforme hôte: fente PCIe Gen5 (ou Gen4 avec rétrocompatibilité mais bande passante limitée)

- Confirmer le type de câble: 400G NDR (OSFP/QSFP-DD) ou splitter pour 2x200G

- Vérifiez le refroidissement: l'adaptateur haute puissance nécessite au moins 300 LFM de flux d'air

- Pour les fonctionnalités de sécurité: confirmer si le démarrage sécurisé et le déchargement cryptographique sont nécessaires (le modèle NEAT inclut le root-of-trust matériel)

- Compatibilité de la version du pilote MLNX_OFED ou de la boîte de réception avec votre noyau/OS

- NVIDIA Quantum-2 NDR InfiniBand Switch (Q9700) - 400G à 64 ports

- NVIDIA BlueField-3 DPU - infrastructure de centre de données programmable

- ConnectX-6 Dx - Adaptateur à double port 200G pour des déploiements rentables

- Les câbles de la série LinkX - 400G DAC/AOC certifiés pour ConnectX-7

- Manuel de l'utilisateur de l'adaptateur PCIe NVIDIA ConnectX-7 (docs.nvidia.com)

- RDMA sur Ethernet convergé (RoCE) Guide de déploiement

- GPUDirect Best Practices pour le stockage

- Le livre blanc sur la technologie NVIDIA SHARP