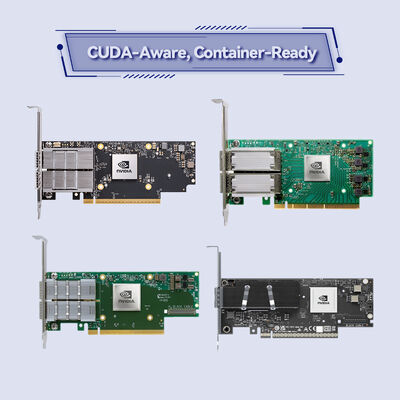

Carte NVIDIA ConnectX-6 InfiniBand MCX653106A-ECAT 200 Gb/s Smart NIC

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX653106A-ECAT |

| Document: | connectx-6-infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Statut des produits: | Action | Application: | Serveur |

|---|---|---|---|

| Type d'interface :: | Infiniband | Ports: | Double |

| Vitesse maximale: | 100 gbe | Taper: | Filaire |

| Condition: | Nouveau et original | Durée de garantie: | 1 an |

| Modèle: | MCX653106A-ECAT | Nom: | Carte réseau Mellanox Original MCX653106A-ECAT connectez X-6 100 Gb/s à double port Adaptateur Ether |

| Mot clé: | carte réseau mellanox | ||

| Mettre en évidence: | NVIDIA ConnectX-6 adaptateur Infiniband,Carte Smart NIC 200 Gb/s,Carte réseau Mellanox avec garantie |

||

Description de produit

Adaptateur intelligent double port 200 Gb/s avec calcul en réseau

Le NVIDIA ConnectX-6 MCX653106A-ECAT offre jusqu'à 200 Gb/s de bande passante, une latence inférieure à la microseconde et des déchargements matériels pour le HPC, l'IA et le stockage hyperconvergé. Doté de RDMA, d'une accélération NVMe-oF, d'un chiffrement XTS-AES au niveau du bloc et du PCIe 4.0, cet adaptateur InfiniBand QSFP56 double port maximise l'efficacité et l'évolutivité du centre de données. Idéal pour les clusters GPU, l'entraînement ML et les réseaux critiques.

Le MCX653106A-ECAT fait partie de la famille d'adaptateurs InfiniBand NVIDIA ConnectX-6, conçue pour les charges de travail les plus exigeantes. Il combine deux ports QSFP56 capables d'une connectivité InfiniBand 200 Gb/s ou Ethernet 200 Gb/s, offrant un transport fiable basé sur le matériel, un contrôle de congestion et des moteurs de calcul en réseau. En déchargeant les opérations collectives, la correspondance de balises MPI et le chiffrement du CPU hôte, l'adaptateur réduit la charge du CPU et augmente les performances des applications dans les clusters à grande échelle. Les entreprises, les laboratoires de recherche et les centres de données hyperscale s'appuient sur ConnectX-6 pour construire des réseaux économes en énergie et à faible latence.

Jusqu'à 200 Gb/s par port (InfiniBand HDR / 200 GbE)

Jusqu'à 215 millions de messages/sec

Niveau bloc XTS-AES 256/512 bits, conforme FIPS

Déchargements collectifs, déchargements cible/initiateur NVMe-oF

PCIe Gen 4.0/3.0 x16 (prise en charge double port)

SR-IOV jusqu'à 1K VFs, ASAP2, déchargement Open vSwitch

Prise en charge RoCE, XRC, DCT, pagination à la demande, routage adaptatif

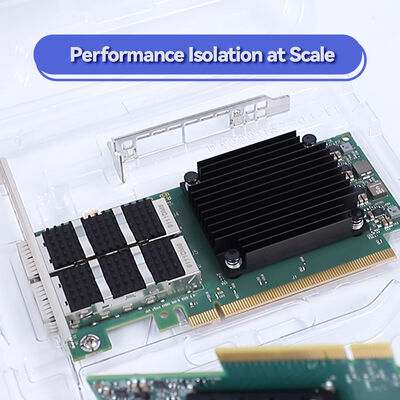

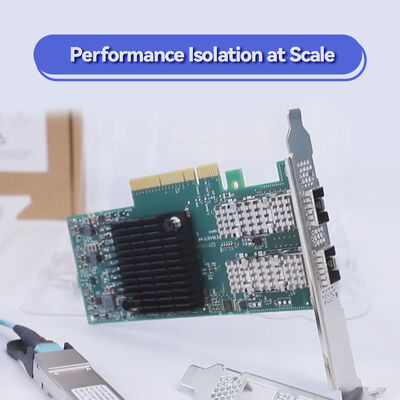

PCIe autonome (profil bas), QSFP56 double port

Construit sur l'architecture InfiniBand éprouvée de NVIDIA, ConnectX-6 intègre le calcul en réseau pour accélérer les opérations MPI, les frameworks d'apprentissage profond et les protocoles de stockage. L'adaptateur prend en charge le Remote Direct Memory Access (RDMA) pour des transferts de données sans copie, contournant le CPU et le noyau. Le contrôle de congestion basé sur le matériel garantit des performances prévisibles même sous forte charge. De plus, NVIDIA GPUDirect RDMA permet un échange de données direct entre la mémoire GPU et l'adaptateur réseau, réduisant considérablement la latence pour l'entraînement IA. Avec la prise en charge des déchargements NVMe over Fabrics (NVMe-oF), la carte réduit l'utilisation du CPU dans les baies de stockage tout en permettant un accès à haut débit et à faible latence au flash NVMe.

- Calcul haute performance (HPC) : Simulations à grande échelle, modélisation météorologique et dynamique des fluides computationnelle nécessitant une faible latence et une bande passante élevée.

- Clusters IA et apprentissage automatique : Entraînement distribué de réseaux neuronaux profonds, exploitant GPUDirect et RDMA pour une efficacité maximale.

- Systèmes de stockage NVMe-oF : Les déchargements cible ou initiateur permettent un stockage désagrégé haute performance avec une faible charge CPU.

- Centres de données hyperscale : Environnements virtualisés avec SR-IOV, réseaux superposés et chaînage de services.

- Services financiers : Infrastructure de trading à latence ultra-faible nécessitant des performances déterministes.

Le ConnectX-6 MCX653106A-ECAT est compatible avec une large gamme de serveurs, de commutateurs et de systèmes d'exploitation. Il interopère avec les commutateurs InfiniBand NVIDIA Quantum (HDR 200 Gb/s), ainsi qu'avec les commutateurs Ethernet 200 GbE. L'adaptateur prend en charge les slots PCIe standard (x16, x8, x4) et inclut la prise en charge des pilotes pour les principales plateformes OS.

| Paramètre | Spécification |

|---|---|

| Modèle de produit | MCX653106A-ECAT |

| Débit de données | 200 Gb/s, 100 Gb/s, 50 Gb/s, 40 Gb/s, 25 Gb/s, 10 Gb/s, 1 Gb/s (InfiniBand et Ethernet) |

| Ports | 2 connecteurs QSFP56 |

| Interface hôte | PCIe Gen 4.0 / 3.0 x16 (prend en charge les configurations x8, x4, x2, x1) |

| Latence | Extrêmement faible, inférieure à la microseconde (typique <0.8µs) |

| Taux de messages | Jusqu'à 215 millions de messages/sec |

| Chiffrement | XTS-AES 256/512 bits, prêt pour la conformité FIPS 140-2 |

| Facteur de forme | PCIe profil bas autonome (support haut monté, support court inclus) |

| Dimensions (sans support) | 167.65mm x 68.90mm |

| Consommation électrique | Typique 22W (selon le trafic) |

| Virtualisation | SR-IOV (1K VFs), VMware NetQueue, NPAR, déchargement de flux ASAP2 |

| Gestion | NC-SI, MCTP sur PCIe/SMBus, PLDM pour mise à jour et surveillance du firmware |

| Démarrage à distance | InfiniBand, iSCSI, PXE, UEFI |

| Systèmes d'exploitation | RHEL, SLES, Ubuntu, Windows Server, FreeBSD, VMware vSphere, pile OFED |

| Numéro de pièce de commande (OPN) | Ports | Vitesse max. | Interface hôte | Différenciateur clé |

|---|---|---|---|---|

| MCX653106A-ECAT | 2x QSFP56 | 100 Gb/s (également inférieur) | PCIe 3.0/4.0 x16 | Double port 100 GbE/IB, déchargements avancés, crypto optionnel ? Pas de crypto intégré dans cette variante, mais prend en charge le chiffrement au niveau du bloc via logiciel ? En fait, moteur AES matériel, consulter la spécification ; idéal pour la virtualisation et le stockage |

| MCX653105A-HDAT | 1x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Port unique 200 Gb/s, prise en charge crypto |

| MCX653106A-HDAT | 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Double port 200 Gb/s pleine bande passante, déchargement crypto |

| MCX653105A-ECAT | 1x QSFP56 | 100 Gb/s | PCIe x16 | Port unique 100 Gb/s, entrée à moindre coût |

| MCX653436A-HDAT (OCP 3.0) | 2x QSFP56 | 200 Gb/s | PCIe 3.0/4.0 x16 | Facteur de forme compact OCP 3.0, double port |

- Performances d'application maximisées : Les déchargements matériels pour MPI, NVMe-oF et le chiffrement libèrent des cœurs de CPU pour les charges de travail réelles.

- Bande passante prête pour l'avenir : Le PCIe 4.0 et la préparation 200 Gb/s garantissent la longévité dans les réseaux à haute vitesse.

- Mémoire et calcul en réseau : Prend en charge les déchargements collectifs et le burst buffer, réduisant la surcharge de mouvement des données.

- Sécurité fiable : Le chiffrement AES-XTS au niveau du bloc avec conformité FIPS garantit la protection des données au repos et en transit sans impact sur les performances.

- Gestion simplifiée : Large prise en charge des OS et hyperviseurs, avec une pile de pilotes unifiée (OFED, WinOF-2).

Hong Kong Starsurge Group fournit un support technique complet, une couverture de garantie et des services RMA pour tous les adaptateurs NVIDIA ConnectX. Notre équipe d'ingénieurs réseau assiste à la configuration, aux mises à jour du firmware et à l'optimisation des performances. Nous offrons une expédition mondiale, des prix de gros pour les projets de centres de données et des réservations de stock personnalisées. Pour les commandes en volume, contactez notre équipe commerciale pour recevoir des devis personnalisés et des détails sur les délais de livraison.

• Confirmez que le slot PCIe fournit une alimentation adéquate (jusqu'à 75W via le slot ; cet adaptateur utilise généralement <25W).

• Pour les plateformes refroidies par liquide, vérifiez la compatibilité avec Intel Server System D50TNP si une variante de plaque froide est nécessaire (cet OPN est refroidi par air standard).

• Vérifiez la compatibilité des pilotes OS avec les dernières piles OFED ou WinOF-2.

Depuis 2008, Hong Kong Starsurge Group Co., Limited fournit du matériel réseau de qualité professionnelle, de l'intégration de systèmes et des services informatiques dans le monde entier. En tant que partenaire de confiance pour les produits réseau NVIDIA, Starsurge propose des solutions certifiées pour les centres de données gouvernementaux, financiers, de santé, éducatifs et hyperscale. Notre équipe technique assure un déploiement fluide, de la conception de l'architecture avant-vente au support après-vente. Avec une philosophie axée sur le client, nous fournissons des composants d'infrastructure personnalisés et évolutifs, y compris des NIC, des commutateurs, des câbles et des solutions réseau de bout en bout.

Livraison mondiale · Support multilingue · Services OEM disponibles

| Composant / Écosystème | Pris en charge | Notes |

|---|---|---|

| Commutateurs NVIDIA Quantum HDR | ✓ Oui | Intégration complète du réseau 200 Gb/s |

| Commutateurs Ethernet 200G/100G | ✓ Oui | Nécessite des modes émetteur-récepteur/FEC compatibles |

| GPU Direct RDMA | ✓ Oui | Séries de GPU NVIDIA prises en charge |

| VMware vSphere / ESXi | ✓ Certifié | Pilotes natifs, prise en charge SR-IOV |

| Windows Server 2019/2022 | ✓ Oui | Package de pilotes WinOF-2 |

| Noyau Linux et OFED | ✓ Prise en charge complète | MLNX_OFED, pilotes intégrés |

- Confirmez la vitesse de liaison requise : les ports doubles 100 Gb/s répondent-ils à votre plan de bande passante de cluster ? Pour les ports doubles 200 Gb/s, envisagez l'OPN -HDAT.

- Vérifiez le slot PCIe du serveur : physique x16, Gen 3 ou Gen 4 recommandé.

- Vérifiez le type de câble : cuivre passif QSFP56 (jusqu'à 5m) ou câbles optiques actifs pour une plus longue portée.

- Assurez-vous que les pilotes du système d'exploitation sont disponibles (OFED, WinOF).

- Pour les exigences de chiffrement : confirmez si le chiffrement au niveau du bloc intégré est nécessaire – le MCX653106A-ECAT prend en charge AES-XTS, mais confirmez toujours le niveau FIPS avec la fiche technique NVIDIA.

- Évaluez les besoins en virtualisation : SR-IOV, déchargement VXLAN, etc.