Carte réseau NVIDIA MCX555A-ECAT 100 Gb/s à port unique QSFP28 InfiniBand PCIe 3.0 x16 ConnectX-5

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX555A-ECAT |

| Document: | CONNECTX-5 infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Statut des produits: | Action | Application: | Serveur |

|---|---|---|---|

| Condition: | Nouveau et original | Taper: | Filaire |

| Vitesse maximale: | EDR et 100GBE | Connecteur Ethernet: | QSFP28 |

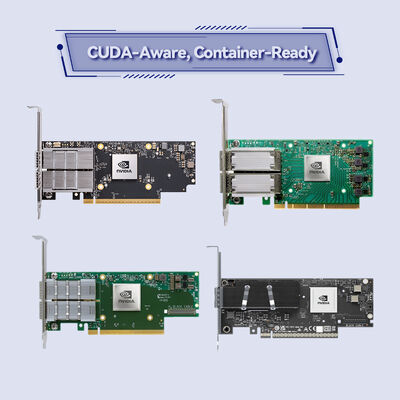

| Mettre en évidence: | Carte InfiniBand NVIDIA ConnectX-5,Carte réseau QSFP28 100 Gb/s,Carte Mellanox PCIe 3.0 x16 |

||

Description de produit

Carte réseau haute performance à faible latence de 100 Gb/s conçue pour les centres de données HPC, IA et cloud. Dotée de délestages avancés, notamment NVMe over Fabrics, GPUDirect RDMA et la mise en correspondance de balises pour les charges de travail MPI, offrant un débit de pointe et une efficacité CPU inégalés.

La NVIDIA ConnectX-5 MCX555A-ECAT est une carte adaptateur InfiniBand à port unique de 100 Gb/s au format PCIe basse consommation. Tirant parti de l'architecture éprouvée ConnectX-5, elle offre un débit allant jusqu'à 100 Gb/s avec une latence inférieure à la microseconde et un taux de messages élevé. La carte prend en charge à la fois InfiniBand (jusqu'à EDR) et 100 GbE, offrant une connectivité polyvalente pour le calcul haute performance, le stockage et les environnements virtualisés.

Construite avec un commutateur PCIe intégré et des capacités RDMA avancées, la MCX555A-ECAT décharge les tâches de communication critiques du CPU, permettant des performances d'application plus élevées, une consommation d'énergie réduite et un coût total de possession inférieur. Elle est entièrement compatible avec les emplacements PCIe 3.0 x16 et prend en charge une large gamme de systèmes d'exploitation et de frameworks d'accélération.

- Jusqu'à 100 Gb/s de connectivité par port (InfiniBand EDR / 100 GbE)

- Connecteur QSFP28 unique pour câbles optiques ou cuivre

- Interface hôte PCIe 3.0 x16 (négociation automatique vers x8, x4, x2, x1)

- RDMA, sémantique d'envoi/réception avec transport fiable basé sur le matériel

- Délestages de mise en correspondance de balises et de prise de contact pour MPI et SHMEM

- Délestages cibles NVMe over Fabrics (NVMe-oF) pour un stockage efficace

- Accélération GPUDirect RDMA (PeerDirect) pour la communication GPU

- Contrôle de congestion basé sur le matériel et prise en charge du routage adaptatif

- Virtualisation SR-IOV : jusqu'à 512 fonctions virtuelles

- Conforme RoHS, format basse consommation (support haut inclus)

L'architecture ConnectX-5 intègre une gamme de moteurs d'accélération matérielle qui réduisent l'intervention du CPU et améliorent l'évolutivité des applications :

- Mise en correspondance de balises MPI et délestage de prise de contact : Déleste le traitement du protocole de mise en correspondance et de prise de contact des messages, améliorant considérablement les performances MPI pour les clusters HPC.

- RDMA hors séquence avec routage adaptatif : Permet une utilisation efficace de plusieurs chemins réseau tout en maintenant la sémantique d'achèvement ordonnée, maximisant l'utilisation du tissu.

- Délestages cibles NVMe-oF : Permet aux systèmes de stockage NVMe de servir l'accès à distance avec une surcharge CPU quasi nulle, idéal pour les architectures de stockage désagrégées.

- Transport connecté dynamique (DCT) : Offre une évolutivité extrême pour les grands systèmes de calcul et de stockage en éliminant la surcharge de configuration des connexions.

- ASAP2 Accelerated Switching & Packet Processing : Délestages matériels pour Open vSwitch (OVS) et le tunneling de réseau superposé (VXLAN, NVGRE, GENEVE).

- Pagination à la demande (ODP) : Prend en charge la pagination de la mémoire virtuelle pour les opérations RDMA, simplifiant le développement d'applications.

- Calcul haute performance (HPC) : Idéal pour les clusters de supercalcul, les simulations basées sur MPI et les charges de travail de recherche scientifique nécessitant une faible latence et des taux de messages élevés.

- Entraînement IA et apprentissage profond : Combiné avec GPUDirect RDMA, permet une communication rapide GPU à GPU entre les nœuds, accélérant les temps d'entraînement.

- Systèmes de stockage NVMe-oF : Déployer comme cibles ou initiateurs de stockage dans des environnements NVMe over Fabrics pour un accès au stockage par blocs à haut débit et faible latence.

- Centres de données cloud et virtualisés : Les délestages SR-IOV et de virtualisation prennent en charge les environnements multi-locataires avec une QoS garantie et une isolation sécurisée.

- Trading haute fréquence (HFT) : La latence ultra-faible et l'horodatage matériel (IEEE 1588v2) répondent aux exigences des applications de services financiers.

La MCX555A-ECAT est conçue pour une large compatibilité avec les commutateurs InfiniBand NVIDIA (par exemple, Quantum, Spectrum) et les commutateurs 100 GbE tiers. Elle prend en charge les câbles DAC passifs en cuivre et les câbles optiques actifs via les ports QSFP28.

Systèmes d'exploitation et piles logicielles :

- RHEL / CentOS, Ubuntu, Windows Server, FreeBSD, VMware ESXi

- OpenFabrics Enterprise Distribution (OFED) / WinOF-2

- NVIDIA HPC-X, OpenMPI, MVAPICH2, Intel MPI, Platform MPI

- Data Plane Development Kit (DPDK) pour le contournement du noyau

| Paramètre | Spécification |

|---|---|

| Modèle | MCX555A-ECAT |

| Facteur de forme | PCIe basse consommation (14,2 cm x 6,9 cm sans support), support haut préinstallé, support court inclus |

| Vitesse et type de port | 1x QSFP28, jusqu'à 100 Gb/s InfiniBand (EDR) et 100 GbE |

| Interface hôte | PCI Express 3.0 x16 (compatible avec x8, x4, x2, x1) |

| Prise en charge InfiniBand | Conforme IBTA 1.3, 100 Gb/s EDR, FDR, QDR, DDR, SDR ; 8 voies virtuelles + VL15 ; 16 millions de canaux d'E/S |

| Prise en charge Ethernet | 100 GbE, 50 GbE, 40 GbE, 25 GbE, 10 GbE, 1 GbE ; IEEE 802.3cd, 802.3bj, 802.3by, 802.3ba, 802.3ae |

| Capacités RDMA | RDMA over Converged Ethernet (RoCE), transport fiable matériel, RDMA hors séquence, opérations atomiques |

| Délestages de stockage | Délestage cible NVMe over Fabrics, iSER, SRP, NFS RDMA, SMB Direct, transfert de signature T10 DIF |

| Virtualisation | SR-IOV (jusqu'à 512 fonctions virtuelles), VMware NetQueue, NPAR, services de contrôle d'accès PCIe (ACS) |

| Délestages CPU | Délestage sans état TCP/UDP/IP, LSO/LRO, délestage de somme de contrôle, RSS/TSS, insertion/suppression de balises VLAN/MPLS |

| Réseaux superposés | Délestages matériels pour l'encapsulation/décapsulation VXLAN, NVGRE, GENEVE |

| Gestion | NC-SI sur MCTP, PLDM pour la surveillance/contrôle et la mise à jour du firmware, I2C, SPI, JTAG |

| Démarrage à distance | Démarrage à distance sur InfiniBand, Ethernet, iSCSI ; prise en charge UEFI, PXE |

| Consommation électrique | Non spécifiée publiquement ; plage typique inférieure à 20 W – veuillez confirmer pour votre système |

| Température de fonctionnement | 0°C à 55°C (environnement typique) |

| Conformité | RoHS, REACH, FCC, CE, VCCI, ICES, RCM |

Remarque : Spécifications dérivées de la documentation produit NVIDIA ConnectX-5. Pour les détails les plus récents et la prise en charge du firmware, reportez-vous aux notes de version officielles de NVIDIA.

| Numéro de pièce de commande | Ports / Vitesse | Interface hôte | Facteur de forme | Caractéristiques principales |

|---|---|---|---|---|

| MCX555A-ECAT | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe basse consommation | Port unique standard, InfiniBand EDR / 100 GbE |

| MCX556A-ECAT | 2x QSFP28, 100 Gb/s | PCIe 3.0 x16 | PCIe basse consommation | Double port, EDR/100 GbE |

| MCX556A-EDAT | 2x QSFP28, 100 Gb/s | PCIe 4.0 x16 | PCIe basse consommation | ConnectX-5 Ex, PCIe Gen4 amélioré |

| MCX556M-ECAT-S25 | 2x QSFP28, 100 Gb/s | 2x PCIe 3.0 x8 | Socket Direct | Connexion serveur double socket via faisceau |

| MCX545B-ECAN | 1x QSFP28, 100 Gb/s | PCIe 3.0 x16 | OCP 2.0 Type 1 | Facteur de forme Open Compute Project |

Pour les variantes OCP ou multi-hôtes, veuillez contacter le service commercial. Toutes les cartes prennent en charge la rétrocompatibilité avec les vitesses inférieures.

- Performances d'application supérieures : Les délestages matériels pour MPI, NVMe-oF et les superpositions libèrent les cœurs CPU pour la logique métier.

- Tissu RDMA évolutif : DCT, XRC et RDMA hors séquence offrent une évolutivité linéaire pour des milliers de nœuds.

- Prêt pour l'accélération GPU : GPUDirect RDMA permet un accès direct à la mémoire entre les GPU et les cartes réseau, éliminant les goulots d'étranglement CPU dans les clusters IA.

- Déploiement flexible : Le port QSFP28 unique simplifie le câblage et est idéal pour les architectures leaf-spine 100 Gb/s.

- Protection de l'investissement : La prise en charge d'InfiniBand et d'Ethernet permet une transition transparente entre les protocoles à mesure que les besoins évoluent.

Hong Kong Starsurge Group fournit un support complet du cycle de vie pour les adaptateurs NVIDIA ConnectX-5, y compris l'assistance à la configuration avant-vente, les conseils de mise à jour du firmware et le service de garantie. Notre équipe technique peut vous aider avec :

- Vérification de la compatibilité avec votre infrastructure serveur et commutateur

- Optimisation des performances pour les charges de travail HPC ou de stockage

- Options de support personnalisées et exigences d'emballage en vrac

- Traitement RMA et services de remplacement avancé

Contactez nos ingénieurs commerciaux pour connaître les prix de volume et les délais de livraison.

Décharge électrostatique (DES) : Utilisez toujours des pratiques de sécurité contre la DES lors de la manipulation de l'adaptateur. Conservez-le dans un emballage antistatique jusqu'à l'installation. Exigences de refroidissement : Assurez une circulation d'air adéquate dans le châssis du serveur pour maintenir la température de fonctionnement dans la plage spécifiée. Mises à jour du firmware : Utilisez les outils de firmware officiels NVIDIA (MFT) et vérifiez la compatibilité avec votre système d'exploitation et votre version de pilote avant la mise à jour. Pliage des câbles : Suivez les directives du rayon de courbure des câbles QSFP28 pour éviter la dégradation du signal.

Il s'agit d'un produit de classe A. Dans un environnement résidentiel, il peut provoquer des interférences radio. Assurez un blindage et une mise à la terre appropriés conformément aux réglementations locales.

Fondé en 2008, Hong Kong Starsurge Group Co., Limited est un fournisseur de matériel réseau, de services informatiques et de solutions d'intégration de systèmes axé sur la technologie. Servant des clients dans le monde entier avec des produits tels que des commutateurs réseau, des cartes réseau, des points d'accès sans fil, des contrôleurs et des câbles haute vitesse, Starsurge combine une expertise technique approfondie avec une approche axée sur le client. L'entreprise soutient des industries telles que le gouvernement, la santé, la fabrication, l'éducation, la finance et les entreprises, offrant des solutions IoT, des systèmes de gestion de réseau, le développement de logiciels personnalisés et une livraison mondiale multilingue. En mettant l'accent sur la qualité fiable et le service réactif, Starsurge aide les clients à construire une infrastructure réseau efficace, évolutive et fiable.

| Composant / Système | Statut de compatibilité | Notes |

|---|---|---|

| Commutateurs InfiniBand NVIDIA Quantum | Certifié | Compatibilité EDR, HDR lors de l'utilisation du firmware approprié |

| Commutateurs Ethernet NVIDIA Spectrum | Certifié | Modes 100 GbE, 50 GbE, 25 GbE pris en charge |

| Commutateurs 100 GbE tiers | Compatible | Nécessite la conformité aux normes IEEE ; testé avec les principaux fournisseurs |

| Serveurs GPU (NVIDIA DGX, HGX) | Certifié avec GPUDirect | Accélération RDMA pour la communication multi-GPU |

| Baies de stockage avec NVMe-oF | Pris en charge | Le délestage cible permet un accès efficace au tissu NVMe |

- ☑ Confirmer que le serveur dispose d'un slot PCIe 3.0 x16 (ou x8) disponible avec un dégagement suffisant.

- ☑ Déterminer le nombre de ports : port unique (MCX555A-ECAT) vs double port (MCX556A-ECAT).

- ☑ Choisir le type de câble : DAC en cuivre passif pour les courtes distances (≤5m) ou optique pour les longues distances.

- ☑ Vérifier la prise en charge du système d'exploitation et des pilotes (OFED, Windows, VMware).

- ☑ Pour les clusters GPU, assurer la compatibilité GPUDirect RDMA avec votre modèle de GPU et votre version de pilote.

- ☑ Vérifier si un support haut ou court est requis pour votre châssis de serveur.

- NVIDIA MCX556A-ECAT – Carte ConnectX-5 double port 100 Gb/s

- NVIDIA MCX556A-EDAT – ConnectX-5 Ex avec prise en charge PCIe 4.0

- Commutateur InfiniBand NVIDIA Quantum-2 QM9700 40 ports 800 Gb/s

- Câbles Mellanox QSFP28 DAC passifs (1m, 2m, 3m)

- Commutateurs Ethernet NVIDIA Spectrum-4 SN5600 100 GbE/400 GbE

- Manuel de l'utilisateur de la carte adaptateur InfiniBand NVIDIA ConnectX-5

- Guide de déploiement RDMA over Converged Ethernet (RoCE)

- Meilleures pratiques GPUDirect RDMA pour les clusters IA

- NVMe over Fabrics avec ConnectX-5 – Guide de configuration

- Guide d'installation et d'optimisation OFED