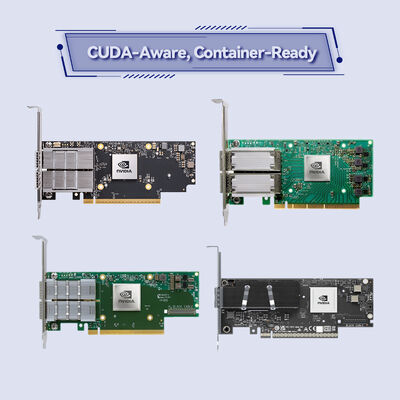

Carte intelligente InfiniBand double port NVIDIA ConnectX-6 MCX653106A-HDAT 200 Gb/s

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX653106A-HDAT-SP |

| Document: | connectx-6-infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Statut des produits: | Action | Application: | Serveur |

|---|---|---|---|

| Condition: | Nouveau et original | Taper: | Filaire |

| Vitesse maximale: | Jusqu'à 200 Go / s | Connecteur Ethernet: | QSFP56 |

| Modèle: | MCX653106A-HDAT | Nom: | Coffre-fort intelligent à grande vitesse de la carte réseau 200gbe de MCX653106A-HDAT-SP Mellanox |

| Mettre en évidence: | NVIDIA ConnectX-6 adaptateur Infiniband,Carte réseau Mellanox de 200 Gb/s,Adaptateur intelligent InfiniBand à double port |

||

Description de produit

NVIDIA ConnectX-6 MCX653106A-HDAT

Adaptateur intelligent HDR InfiniBand à double port de 200 Gb/s

Débloquez des performances HPC et IA extrêmes avec NVIDIA In-Network Computing. Cet adaptateur PCIe 4.0 x16 fournit 215 millions de messages / seconde et une accélération basée sur le matériel pour les centres de données les plus exigeants.

Vue d'ensemble du produit

Le NVIDIA ConnectX-6 MCX653106A-HDAT est un adaptateur intelligent InfiniBand et Ethernet à double port de 200 Gb / s, conçu comme une pierre angulaire de la plate-forme NVIDIA Quantum InfiniBand.Il intègre des fonctionnalités avancées comme l'accès direct à la mémoire à distance (RDMA)En déplaçant le calcul dans le tissu de réseau, le processeur est en mesure de gérer les flux de données.Cet adaptateur améliore l'évolutivité et l'efficacité pour l'informatique haute performance, des charges de travail d'apprentissage automatique et des infrastructures cloud hyperscale.

Principales caractéristiques

- Le débit ultra-haute:une connectivité de 200 Gbps par port avec une bande passante globale maximale de 200 Gbps.

- L'informatique en réseau:Déchargement du matériel pour les opérations collectives, correspondance des balises MPI et protocole de rendez-vous.

- chiffrement au niveau du bloc:chiffrement matériel XTS-AES 256/512 bits pour la sécurité des données conforme au FIPS.

- Prise en charge du PCIe 4.0:16 GT/s de vitesse de liaison avec une compatibilité arrière complète avec PCIe 3.0/2.0/1.1.

- Taux de diffusion:Jusqu'à 215 millions de messages par seconde pour des performances extrêmes de petits paquets.

- Décharges de stockage:Les décharges de cible et d'initiateur NVMe-oF, T10-DIF, et le support de SRP, iSER, NFS RDMA.

- Virtualisation:SR-IOV avec des fonctions virtuelles allant jusqu'à 1K et ASAP2 pour le déchargement OVS.

Technologie de calcul en réseau NVIDIA

ConnectX-6 intègre les moteurs In-Network Computing uniques de NVIDIA, déchargeant les opérations de communication collective (comme MPI all-reduce) du processeur vers le tissu réseau.Cela réduit considérablement la latence et libère des cycles de processeur pour le traitement des applicationsCombiné avec RDMA et la cartographie avancée de mémoire (UMR), l'adaptateur permet la communication GPU Direct RDMA et peer-to-peer GPU à travers le réseau,accélérer les groupes de formation en IA et les simulations complexes.

Des déploiements typiques

- "Télécommunications" à haute performance (HPC):Des grappes à grande échelle qui exécutent la simulation météorologique, la dynamique des fluides et la dynamique moléculaire.

- IA et apprentissage automatique:Formation distribuée de réseaux neuronaux profonds nécessitant un débit élevé et une faible latence.

- Centres de données d'entreprise:Objectifs de stockage NVMe-oF, accélération de base de données et infrastructure virtualisée.

- Le nuage hyperscale:Environnements multi-locataires nécessitant un isolement et une qualité de service basés sur le matériel.

- Plateformes refroidies par liquide:Compatible avec le système de serveur Intel D50TNP pour les déploiements à haute densité.

Compatibilité

Système et processeur:x86, Power, Arm, GPU (avec GPUDirect) et plateformes basées sur FPGA.

Commutateur:Entièrement interopérable avec les commutateurs NVIDIA Quantum InfiniBand jusqu'à 200 Gbps et les commutateurs Ethernet standard.

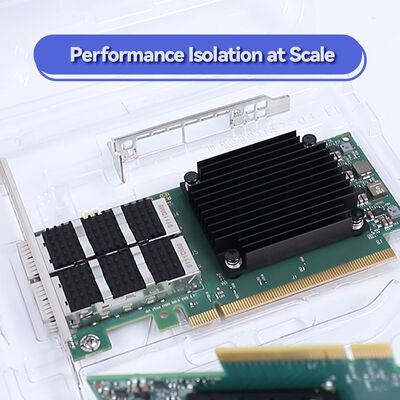

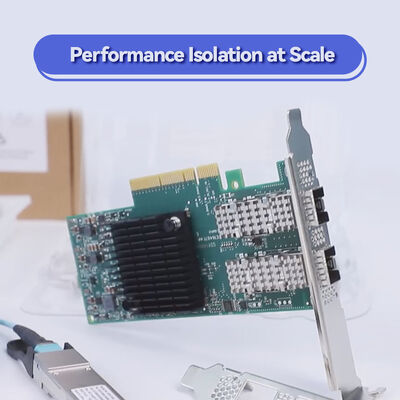

Les câbles:Des câbles en cuivre passif, optique actif et DAC avec connecteurs QSFP56.

Spécifications techniques

| Paramètre | Détails |

|---|---|

| Nom du produit | NVIDIA ConnectX-6 MCX653106A-HDAT |

| Vitesses prises en charge | Pour les appareils de communication électronique, le nombre de lignes de fréquences est déterminé en fonction de la fréquence de l'appareil. |

| Ports réseau | 2x QSFP56 |

| Interface de l'hôte | PCIe Gen 4.0/3.0 x16 (prend également en charge x8, x4, x2, x1) |

| Taux de diffusion | Jusqu'à 215 millions de messages par seconde |

| Caractéristiques InfiniBand | RDMA, XRC, DCT, ODP, contrôle de la congestion matérielle, canaux d'entrée/sortie 16M, 8 VL + VL15 |

| Décharges Ethernet | Le système de gestion de l'équipement est basé sur les critères suivants: |

| Décharges de stockage | Les activités de recherche et de développement doivent être réalisées par des professionnels qualifiés. |

| Sécurité | Hardware XTS-AES 256/512 bits de chiffrement par bloc, conforme à FIPS |

| La gestion | NC-SI, MCTP sur SMBus/PCIe, PLDM pour le moniteur/firmware, I2C, JTAG |

| Les dimensions | 167.65 mm x 68,90 mm (sans crochets) |

| Réglementation | Compatible avec les normes RoHS et ODCC |

Remarque: les spécifications sont basées sur la documentation disponible. Pour plus de détails, veuillez confirmer avant de commander.

Guide de sélection: MCX653106A-HDAT

Ce modèle est la variante QSFP56 à double port dans le facteur de forme stand-up PCIe. Il prend en charge à la fois InfiniBand et Ethernet à des vitesses allant jusqu'à 200 Gb / s. Pour les besoins de port unique, considérez le MCX653105A-HDAT.Pour l'OCP 3.0 facteur de forme, voir la série MCX653436A-HDAT.

| Les ports | Facteur de forme | OPN | Cas d' utilisation |

|---|---|---|---|

| 2x QSFP56 | Résistance au PCIe | Le numéro de série de l'appareil doit être identifié. | Deux ports 200 Gb/s pour les nœuds HPC/IA à haute disponibilité |

| 1x QSFP56 | Résistance au PCIe | Le numéro de série de l'appareil doit être identifié. | Port unique 200 Gb/s pour le calcul standard |

| 2x QSFP56 | Socket Direct | Le nombre d'émissions de CO2 est déterminé par la méthode suivante: | Optimisation du serveur multi-sockets |

Avantages du connecteur connectX-6 MCX653106A-HDAT

- Résistant au futur:La préparation PCIe 4.0 assure une bande passante pour les processeurs et GPU de nouvelle génération.

- Sécurité par défaut:Le cryptage intégré conforme à FIPS élimine le besoin de disques auto-cryptés.

- Consolidation des infrastructures:Un adaptateur prend en charge à la fois InfiniBand et Ethernet, simplifiant l'inventaire.

- Stockage évolutif:Les décharges NVMe-oF complètes réduisent la charge du processeur dans les architectures de stockage désagrégées.

Service et soutien

Soutenus par l'équipe technique expérimentée de Hong Kong Starsurge Group, nous fournissons:

- Assistance à la configuration avant vente pour votre environnement HPC ou d'entreprise spécifique.

- Expédition mondiale avec suivi et emballage sécurisé.

- Guide de mise à jour du micrologiciel et support de téléchargement des pilotes.

- Services de garantie et RMA (les conditions peuvent varier selon les régions).

Questions fréquemment posées

Q: Cette carte est-elle compatible avec les commutateurs Ethernet standard?

R: Oui, le MCX653106A-HDAT prend en charge InfiniBand et Ethernet. Il peut fonctionner à 200/100/50/40/25/10/1GbE.

Q: Est-ce qu'il prend en charge NVIDIA GPUDirect?

R: Absolument. Il prend en charge GPUDirect RDMA et PeerDirect pour la communication directe GPU-GPU sur le réseau.

Q: Quelle est la différence entre MCX653106A-HDAT et MCX653106A-ECAT?

R: Le suffixe -HDAT indique la variante haute vitesse prenant en charge 200Gb/s, tandis que -ECAT désigne généralement une version à basse vitesse (100Gb/s).

Q: Puis-je utiliser cette carte dans un emplacement PCIe Gen 3?

R: Oui, il est rétrocompatible avec PCIe Gen 3.0, mais la bande passante sera limitée à ~ 100 Gb/s par port en raison du bus plus lent.

Précautions d'installation

- Assurer un débit d'air adéquat; l'adaptateur peut nécessiter un refroidissement actif dans des environnements denses.

- Utiliser uniquement des modules et des câbles QSFP56 validés pour un fonctionnement de 200 Gb/s afin d'éviter l'instabilité des liaisons.

- Vérifiez le support de bifurcation des fentes PCIe de votre carte mère si vous utilisez la variante Socket Direct.

- Confirmer le budget énergétique: la carte reçoit de l'énergie du slot PCIe; les modules optiques à haute puissance peuvent nécessiter une prise en compte supplémentaire de l'énergie.

À propos de Hong Kong Starsurge Group Co., Limited

Fondé en 2008, le groupe Starsurge de Hong Kong est un fournisseur de matériel réseau, de services informatiques et de solutions d'intégration de systèmes axé sur la technologie.Nous servons des clients dans le monde entier avec des produits incluant des commutateurs réseauNotre équipe expérimentée de ventes et technique soutient des industries telles que le gouvernement, la santé, la fabrication, l'éducation,les financesAvec une approche axée sur le client, Starsurge se concentre sur une qualité fiable, un service réactif et des solutions sur mesure qui aident les clients à construire des solutions efficaces, évolutives,et une infrastructure de réseau fiableNous offrons des solutions IoT, des systèmes de gestion de réseau, le développement de logiciels personnalisés, le support multilingue, et la livraison mondiale.

Un aperçu des faits clés

Matrice de compatibilité

| Composant | Soutenu? | Les notes |

|---|---|---|

| Les commutateurs quantiques NVIDIA | - Oui, oui. | Interopérabilité HDR complète de 200 Gb/s |

| Les cartes mères PCIe de la génération 4.0 | - Oui, oui. | Taux de ligne complet de 200 Gb/s |

| Les cartes mères PCIe de la génération 3.0 | - Oui, oui. | Limité à ~ 100 Gb/s par port |

| VMware vSphere | - Oui, oui. | Chauffeurs disponibles |

| Intel D50TNP refroidi par liquide | UGS spéciales | La version de la plaque froide existe; confirmer le PNO |

Liste de vérification de l'acheteur

- Le serveur de confirmation dispose d'un emplacement libre PCIe 4.0 x16 (physique et électrique).

- Vérifier la vitesse de fabrication InfiniBand: cette carte est compatible HDR (200 Gb/s).

- Choisissez les modules QSFP56 appropriés (SR, LR ou DAC) pour votre distance.

- Veiller à ce que la puissance et le refroidissement soient suffisants pour un fonctionnement à grande vitesse.

- Vérifiez le support du système d'exploitation/du pilote: RHEL, Ubuntu, Windows Server, etc.