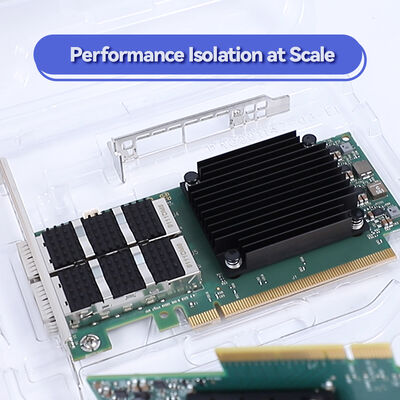

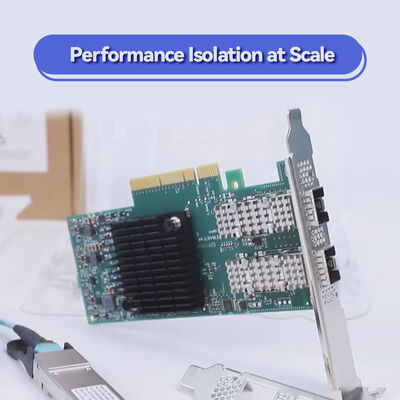

NVIDIA ConnectX-7 NDR 400Gb/s Adaptateur InfiniBand MCX75310AAS-HEAT

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX75310AAS-HEAT (900-9x766-003N-S0) |

| Document: | Connectx-7 infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Numéro de modèle.: | MCX75310AAS-HEAT (900-9x766-003N-S0) | Ports: | Port unique |

|---|---|---|---|

| Technologie: | Infiniband | Type d'interface: | OSFP56 |

| Spécification: | 16,7 cm x 6,9 cm | Origine: | Inde / Israël / Chine |

| taux de transmission: | 200 gbe | Interface hôte: | Gen3 x16 |

Description de produit

Réseau RDMA à latence ultra-faible pour les usines d'IA, les clusters HPC et le cloud hyperscale. Prend en charge InfiniBand NDR (400 Gbit/s) et Ethernet jusqu'à 400 GbE. Moteurs de calcul en réseau, accélération matérielle de la sécurité et prêt pour GPUDirect® Storage.

La famille NVIDIA ConnectX-7 redéfinit l'interconnexion des centres de données avec une bande passante allant jusqu'à 400 Gbit/s, un transport fiable basé sur le matériel et un calcul avancé en réseau. Le modèle MCX75310AAS-HEAT appartient à la série d'adaptateurs ConnectX-7 VPI prenant en charge InfiniBand (NDR/HDR/EDR) et Ethernet (400 GbE à 10 GbE). Conçu pour l'IA, le calcul scientifique et le stockage moderne défini par logiciel, il offre une latence inférieure à la microseconde et libère les cœurs de processeur grâce à des moteurs d'accélération pour la sécurité, la virtualisation et NVMe-oF. Avec une interface hôte PCIe Gen5, cet adaptateur maximise le mouvement des données pour les clusters GPU et les environnements de trading à haute fréquence.

Exploitant ASAP² (Accelerated Switch and Packet Processing) et Zero-Touch RoCE, l'adaptateur simplifie le déploiement tout en fournissant un chiffrement matériel en ligne – du bord au cœur. Les entreprises peuvent pérenniser leur infrastructure avec des vitesses NDR et un support multi-hôtes flexible.

Double port InfiniBand NDR 400 Gbit/s ou 400 GbE, PCIe Gen5 x16 (jusqu'à 32 voies).

Déchargement des opérations collectives SHARPv3, déchargement du protocole de jonction, mémoire intégrée pour les rafales.

Chiffrement IPsec/TLS/MACsec AES-GCM 128/256 bits en ligne, démarrage sécurisé avec racine de confiance matérielle, chiffrement flash.

IEEE 1588v2 PTP (précision de 12 ns), SyncE, classe C G.8273.2, cadencement déclenché par le temps.

GPUDirect RDMA, GPUDirect Storage, déchargement NVMe-oF, transfert de signature T10-DIF.

VXLAN, GENEVE, NVGRE, analyseur flexible programmable, suivi de connexion (pare-feu L4).

NVIDIA ASAP² (Accelerated Switch and Packet Processing) décharge des chemins de données entiers, offrant des performances SDN à débit de ligne sans surcharge CPU. ConnectX-7 intègre une virtualisation de mémoire avancée : pagination à la demande (ODP), enregistrement en mode utilisateur (UMR) et services de traduction d'adresses (ATS) pour des charges de travail conteneurisées efficaces. Avec la prise en charge de SR-IOV, de l'accélération VirtIO et de la technologie Multi-Host (jusqu'à 4 hôtes), l'adaptateur offre des performances bare-metal dans les environnements virtualisés. Le moteur RoCE matériel garantit un déploiement sans intervention pour les fabrics Ethernet convergées, tandis que la mémoire en réseau réduit la latence pour les bibliothèques de communication MPI et collectives (NVIDIA HPC-X, UCX, NCCL).

Pour répondre aux exigences de sécurité du bord au cœur, les moteurs de chiffrement en ligne gèrent IPsec, TLS 1.3 et MACsec sans consommer de cœurs d'exécution, ce qui les rend idéaux pour les clouds multi-locataires et les services financiers.

- Clusters IA & grands modèles linguistiques : RDMA & GPUDirect accélérant l'entraînement distribué sur des centaines de GPU.

- Calcul haute performance (HPC) : Déchargements MPI, SHARPv3 pour la réduction en réseau, routage adaptatif.

- Centres de données cloud et périphériques : Accélération du réseau overlay, déchargement VXLAN, SR-IOV.

- Stockage défini par logiciel (SDS) : NVMe/TCP, NVMe-oF, iSER, NFS sur RDMA.

- Analyses en temps réel & trading : Latence ultra-faible + synchronisation de classe C PTP.

| Composant / Écosystème | Options prises en charge |

|---|---|

| Interface hôte | PCIe Gen5 (jusqu'à x32 voies, x16 typique), bifurcation PCIe, Multi-Hôte (4 hôtes) |

| Systèmes d'exploitation | Linux (RHEL, Ubuntu, pilotes intégrés), Windows Server, VMware ESXi (SR-IOV), Kubernetes |

| Virtualisation & Conteneurs | SR-IOV, accélération VirtIO, déchargement NVMe sur TCP pour les conteneurs |

| Middleware / Bibliothèques HPC | OpenMPI, MVAPICH, MPICH, UCX, NCCL, UCC, OpenSHMEM, PGAS |

| Protocoles de stockage | NVMe-oF (RDMA/TCP), SRP, iSER, NFS sur RDMA, SMB Direct, GPUDirect Storage |

| Paramètre | Spécification |

|---|---|

| Modèle de produit | MCX75310AAS-HEAT |

| Facteurs de forme | PCIe HHHL / FHHL, OCP 3.0 SFF/TSFF (voir guide de commande) |

| Vitesses InfiniBand | NDR 400 Gbit/s, HDR 200 Gbit/s, EDR 100 Gbit/s |

| Vitesses Ethernet | 400 GbE, 200 GbE, 100 GbE, 50 GbE, 25 GbE, 10 GbE (NRZ/PAM4) |

| Ports réseau | Configurations 1/2/4 ports (selon le SKU ; 2 ports typiques pour ce modèle) |

| Bus hôte | PCI Express Gen 5.0 (compatible Gen4/Gen3), jusqu'à x32 voies, indices de traitement TLP, ATS, PASID |

| Déchargements de sécurité | IPsec en ligne (AES-GCM 128/256), TLS 1.3, MACsec, démarrage sécurisé, chiffrement flash, authentification de périphérique |

| RDMA / Transport | Transport fiable matériel, XRC, DCT, pagination à la demande, UMR, GPUDirect RDMA |

| Synchronisation et cadencement | IEEE 1588v2 PTP, G.8273.2 Classe C, précision de 12 ns, SyncE, PPS entrée/sortie, planification déclenchée par le temps |

| Gestion | NC-SI, MCTP sur PCIe/SMBus, PLDM (DSP0248/0267/0218), SPDM, flash SPI, JTAG |

| Démarrage à distance | Démarrage à distance InfiniBand, iSCSI, UEFI, PXE |

| Réseau ouvert | ASAP² pour SDN, déchargement VXLAN/GENEVE/NVGRE, mise en miroir de flux, QoS hiérarchique, suivi de connexion L4 |

| Alimentation et environnement | Voir le manuel d'utilisation (typiquement ~15W-25W selon la configuration), température de fonctionnement : 0°C à 55°C (non spécifié publiquement, confirmer par SKU) |

| Exemple de numéro de pièce | Ports / Vitesse | Facteur de forme | Utilisation typique |

|---|---|---|---|

| MCX75310AAS-HEAT | Double port NDR 400 Gbit/s, PCIe 5.0 x16 | PCIe HHHL / FHHL | IA et HPC en haut de rack, clusters GPU |

| MCX75340AAS-HEAT (exemple) | 4 ports NDR200 / 200 GbE | OCP 3.0 | Hyperscale et multi-hôtes |

| Autres SKUs ConnectX-7 | Port simple/double, 100G/200G/400G | OCP, FHHL | Appareils d'entreprise, de stockage |

Pour obtenir de l'aide pour choisir le bon SKU (prise en charge des câbles, type de support, support haut/bas) contactez l'équipe Starsurge.

- ✅ Pièces authentiques et certifiées – garantie complète, chaîne d'approvisionnement sécurisée.

- ✅ Conseil en architecture avant-vente – conception de clusters HPC / IA, réglage RDMA.

- ✅ Logistique mondiale et expédition rapide – stocks en Asie/Europe/Amériques.

- ✅ Firmware personnalisé et options OEM – demande de configuration en volume.

- ✅ Support technique après-vente – intégration de pilotes, mises à jour de firmware, RMA.

Hong Kong Starsurge Group fournit un support complet sur le cycle de vie : de la validation de la compatibilité au déploiement et à la maintenance continue. Nos ingénieurs assistent pour :

- Conception de fabric InfiniBand et optimisation des performances.

- Configuration RoCE pour les environnements Ethernet.

- Intégration avec les cibles GPUDirect Storage et NVMe-oF.

- Garantie standard de 3 ans plus couverture étendue disponible.

Prix de volume, expédition en gros et personnalisation (supports, languettes de traction) disponibles sur demande.

NDR inclut des fonctionnalités de calcul en réseau avancées comme SHARP, le routage adaptatif et le transport fiable matériel nativement ; le mode Ethernet utilise RoCE pour RDMA avec le même débit. ConnectX-7 prend en charge les deux via une double personnalité.

Oui, l'adaptateur est rétrocompatible avec PCIe Gen4 et Gen3, mais à une vitesse de voie réduite. Les meilleures performances sont obtenues sur les slots PCIe Gen5.

Oui, ConnectX-7 prend en charge la technologie NVIDIA Multi-Host, permettant à jusqu'à 4 hôtes indépendants de partager le même adaptateur (dépend du SKU spécifique et du câblage). Veuillez confirmer avec le guide de commande.

IPsec (AES-GCM 128/256 bits), TLS (AES-GCM 128/256 bits) et MACsec (AES-GCM 128/256 bits). Tous déchargés du CPU.

Absolument. ConnectX-7 décharge NVMe sur TCP ainsi que NVMe-oF, réduisant la surcharge du CPU hôte pour le stockage.

- Assurez une bonne circulation de l'air dans le châssis du serveur lors de l'utilisation d'émetteurs-récepteurs haute puissance (optiques actifs ou DAC).

- Utilisez le firmware fourni par NVIDIA ou validé par Starsurge pour les correctifs de sécurité.

- Installez le dernier pilote (MLNX_OFED ou natif intégré) pour activer les déchargements matériels complets.

- Vérifiez la compatibilité QSFP-DD ou OSFP pour les optiques 400G ; consultez le guide des émetteurs-récepteurs Ethernet NVIDIA.

- Manipulation antistatique requise – l'adaptateur contient des composants PCIe sensibles.

Hong Kong Starsurge Group Co., Limited est un fournisseur axé sur la technologie de matériel réseau, de services informatiques et de solutions d'intégration de systèmes. Fondée en 2008, l'entreprise dessert des clients dans le monde entier avec des produits tels que des commutateurs réseau, des cartes réseau, des points d'accès sans fil, des contrôleurs, des câbles et des équipements associés. Soutenu par une équipe de vente et technique expérimentée, Starsurge dessert des industries telles que le gouvernement, la santé, la fabrication, l'éducation, la finance et les entreprises. L'entreprise propose également des solutions IoT, des systèmes de gestion de réseau, le développement de logiciels personnalisés, un support multilingue et une livraison mondiale. Avec une approche axée sur le client, Starsurge se concentre sur une qualité fiable, un service réactif et des solutions sur mesure qui aident les clients à construire une infrastructure réseau efficace, évolutive et fiable.

✓ Partenaire agréé pour les grandes marques, y compris les produits réseau NVIDIA.

| Débit maximal | 400 Gbit/s (NDR / 400 GbE) | PCIe Gen5 | Jusqu'à 32 voies |

|---|---|---|---|

| Prise en charge RDMA | InfiniBand & RoCE | Sécurité | IPsec/TLS/MACsec en ligne |

| GPUDirect | RDMA + Stockage | Précision de synchronisation | PTP 12 ns |

| Composant | Recommandé / Pris en charge | Remarques |

|---|---|---|

| Serveurs GPU (HGX/DGX) | Entièrement compatible avec GPUDirect | Déchargement SHARP sur InfiniBand |

| Commutateurs Top-of-Rack | NVIDIA QM9700 (NDR), SN4000 (Ethernet) | Pris en charge |

| Hôtes de virtualisation | VMware ESXi 7.0/8.0, KVM, Hyper-V | SR-IOV activé |

| Systèmes de stockage | PureStorage, VAST Data, WEKA, Dell PowerScale | Prêt pour NVMe-oF / RoCE |

| Câbles / Optiques | Câbles DAC passifs NVIDIA, optiques actifs (400G SR4/DR4) | Confirmer la matrice de compatibilité |

- Confirmer que la configuration des ports (NDR double port ou 2x200G divisé) correspond à votre plan de commutation.

- Confirmer la longueur physique du slot PCIe et le type de support (HHHL / FHHL).

- Vérifier la direction du flux d'air et les exigences des câbles passifs/actifs.

- Assurer la prise en charge des pilotes OS (version MLNX_OFED pour votre noyau).

- Pour les fonctionnalités de sécurité : activer le démarrage sécurisé et le chiffrement en ligne dans le firmware.

- Examiner les options de garantie et de remplacement anticipé.

64 ports 400G InfiniBand, intégration SHARPv3.

200 Gbit/s rentable pour les clusters plus petits.

Accélération du stockage et de la sécurité + chemin de données programmable.

OSFP conforme vers 2xOSFP ou 2xQSFP56.