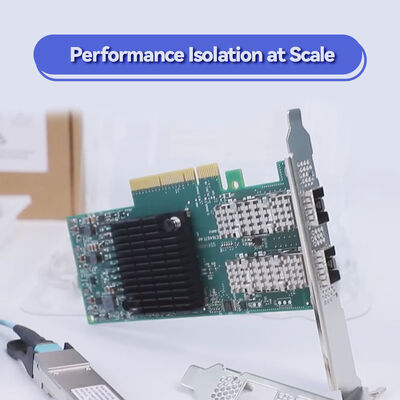

Carte réseau NVIDIA Mellanox ConnectX-6 MCX653106A-ECAT 100 Gb/s double port InfiniBand avec capacité Ethernet

Détails sur le produit:

| Nom de marque: | Mellanox |

| Numéro de modèle: | MCX653106A-ECAT |

| Document: | connectx-6-infiniband.pdf |

Conditions de paiement et expédition:

| Quantité de commande min: | 1 pièces |

|---|---|

| Prix: | Negotiate |

| Détails d'emballage: | Boîte extérieure |

| Délai de livraison: | Basé sur l'inventaire |

| Conditions de paiement: | T/T |

| Capacité d'approvisionnement: | Fourniture par projet / lot |

|

Détail Infomation |

|||

| Statut des produits: | Action | Application: | Serveur |

|---|---|---|---|

| Type d'interface :: | Infiniband | Ports: | Double |

| Vitesse maximale: | 100 gbe | Taper: | Filaire |

| Condition: | Nouveau et original | Durée de garantie: | 1 an |

| Modèle: | MCX653106A-ECAT | Nom: | NIC ConnectX- de MCX653106A-ECAT Mellanox 100gb 6 VPI Hdr100 Edr Ib à double accès |

| Mot clé: | carte réseau mellanox | ||

| Mettre en évidence: | Carte réseau Mellanox ConnectX-6,carte Ethernet InfiniBand 100 Gb/s,carte réseau Mellanox double port |

||

Description de produit

Carte adaptateur InfiniBand et Ethernet double port 100 Gb/s polyvalente avec interface PCIe 3.0/4.0 x16, offrant des délestages RDMA, NVMe-oF, un chiffrement au niveau du bloc et le calcul en réseau pour des déploiements HPC, d'entreprise et cloud optimisés en termes de coûts.

- Connectivité InfiniBand double port 100 Gb/s (EDR/HDR100) et 100/50/40/25/10 GbE

- PCIe Gen 3.0/4.0 x16 (rétrocompatible) | Jusqu'à 215 millions de messages par seconde

- Délestages matériels : cible/initiateur NVMe-oF, chiffrement XTS-AES 256/512 bits, mise en correspondance de balises MPI

- Prise en charge du calcul en réseau NVIDIA et du RDMA GPUDirect

- Format compact PCIe surélevé, conforme RoHS

- Débit de 100 Gb/s : Ports doubles fonctionnant jusqu'à 100 Gb/s InfiniBand (EDR/HDR100) ou Ethernet avec bande passante bidirectionnelle complète.

- Calcul en réseau : Déleste les opérations collectives (MPI, NCCL, SHMEM) à l'aide de la technologie NVIDIA SHARP.

- Chiffrement au niveau du bloc : Chiffrement/déchiffrement matériel AES-XTS 256/512 bits sans surcharge CPU ; conforme FIPS.

- Délestages NVMe-oF : Délestages cible et initiateur pour NVMe over Fabrics, réduisant l'utilisation du CPU.

- Virtualisation avancée : SR-IOV jusqu'à 1K VF, accélération ASAP² pour OVS et commutation virtuelle.

Le MCX653106A-ECAT intègre les moteurs de calcul en réseau NVIDIA (SHARP), RDMA (IBTA 1.3), RoCE, et NVMe-oF. Il prend en charge PCIe Gen 4.0 (x16) et Gen 3.0, PAM4 et NRZ SerDes, et des fonctionnalités avancées telles que Dynamically Connected Transport (DCT), On-Demand Paging (ODP), et Adaptive Routing. Les délestages de superposition pour VXLAN, NVGRE, Geneve sont accélérés matériellement. Conforme aux spécifications IEEE 802.3bj, 802.3bm, 802.3by et InfiniBand Trade Association.

ConnectX-6 décharge les tâches de communication et de stockage du CPU hôte vers le matériel de l'adaptateur. Pour les collectifs MPI, l'adaptateur traite les données en transit à l'aide de SHARP, réduisant le trafic d'extrémité. Pour le stockage, les commandes NVMe-oF sont traitées directement sur l'adaptateur, libérant les cœurs CPU. Le chiffrement/déchiffrement de bloc s'effectue en ligne à la vitesse du câble. Le résultat est une latence plus faible, un taux de messages plus élevé (215 Mpps) et une meilleure évolutivité des applications, même à des vitesses de 100 Gb/s.

- Clusters HPC de milieu de gamme : Simulations basées sur MPI nécessitant une interconnexion 100 Gb/s économique.

- Inférence et entraînement IA : Clusters GPU avec RDMA GPUDirect et collectifs NCCL.

- Stockage NVMe-oF : Délestages cible/initiateur pour un accès au stockage NVMe haute performance.

- Centres de données virtualisés : SR-IOV et ASAP² pour le délestage OVS dans les environnements NFV et cloud.

- Cloud d'entreprise : Connectivité Ethernet 100 Gb pour la virtualisation et la convergence du stockage.

| Modèle | Ports et vitesse | Interface hôte | Facteur de forme | Chiffrement | Protocoles | OPN |

|---|---|---|---|---|---|---|

| ConnectX-6 | 2x QSFP56 (100 Gb/s IB/Eth) | PCIe 3.0/4.0 x16 | PCIe surélevé (profil bas) | AES-XTS 256/512 bits | InfiniBand, Ethernet, NVMe-oF | MCX653106A-ECAT |

| ConnectX-6 | 1x QSFP56 (100 Gb/s) | PCIe 4.0 x8 | PCIe surélevé | AES-XTS | IB/Eth | MCX651105A-EDAT |

| ConnectX-6 | 2x QSFP56 (200 Gb/s) | PCIe 4.0 x16 | PCIe surélevé | AES-XTS | IB/Eth | MCX653106A-HDAT |

Remarque : Le MCX653106A-ECAT prend en charge l'InfiniBand 100 Gb/s (EDR/HDR100) et l'Ethernet 100/50/25/10 GbE. Dimensions : 167,65 mm x 68,90 mm (sans support). Inclut un support haut (accessoire de support court). Consommation électrique < 15 W typique.

- par rapport à ConnectX-5 : Double bande passante (100 Gb/s contre 50 Gb/s), SHARP intégré pour le calcul en réseau, et chiffrement au niveau du bloc sans coût supplémentaire.

- par rapport aux cartes réseau concurrentes : Véritable délestage matériel pour NVMe-oF et les collectifs MPI, pas seulement des délestages sans état.

- 100G optimisé en coût : Idéal pour équilibrer performance et budget dans les clusters de taille moyenne.

- Conformité FIPS : Le chiffrement matériel répond aux normes de sécurité gouvernementales.

Nous offrons une consultation technique 24h/24 et 7j/7, des services RMA et un support d'intégration pour les adaptateurs ConnectX-6. Chaque carte est couverte par une garantie de 1 an (extensible). Notre équipe fournit une validation des pilotes pour les principales distributions Linux, Windows et VMware. Une assistance à la configuration avant-vente pour la conception de réseaux InfiniBand/Ethernet est disponible.

Q : Le MCX653106A-ECAT est-il compatible avec les commutateurs Quantum 200 Gb/s ?

R : Oui, il est interopérable avec les commutateurs NVIDIA Quantum QM8700/QM8790 en mode HDR100 (100 Gb/s par port).

Q : Cet adaptateur peut-il être utilisé pour l'Ethernet ainsi que pour l'InfiniBand ?

R : Oui, il prend en charge les protocoles InfiniBand et Ethernet. Le firmware détecte automatiquement le type de commutateur et configure le mode approprié.

Q : Prend-il en charge RoCE (RDMA over Converged Ethernet) ?

R : Oui, ConnectX-6 prend entièrement en charge RoCE, offrant un RDMA à faible latence dans les environnements Ethernet.

Q : Quel est le taux de messages maximum ?

R : L'adaptateur délivre jusqu'à 215 millions de messages par seconde, idéal pour les charges de travail HPC à petits paquets.

Q : La carte est-elle compatible avec les slots PCIe Gen 3.0 ?

R : Oui, elle est entièrement compatible avec les slots PCIe Gen 3.0 x16 ; les performances seront limitées à environ 100 Gb/s agrégés, ce qui correspond à la vitesse du port.

- Exigence de slot PCIe : Pour des performances optimales, installez dans un slot PCIe Gen 3.0 x16 ou Gen 4.0 x8/x16.

- Refroidissement : Assurez une circulation d'air adéquate dans le châssis du serveur ; le refroidissement passif nécessite un minimum de 200 LFM.

- Câblage : Utilisez des modules QSFP56 en cuivre passif/actif ou optiques classés pour 100 Gb/s (EDR/HDR100).

- Prise en charge des pilotes : Utilisez la dernière version de NVIDIA MLNX_OFED pour Linux ou WinOF-2 pour Windows.

- Température de fonctionnement : 0°C à 70°C ; stocker entre -40°C et 85°C.

Avec plus d'une décennie d'expérience, nous exploitons une usine à grande échelle soutenue par une solide équipe technique. Notre vaste clientèle et notre expertise du domaine nous permettent d'offrir des prix compétitifs sans compromettre la qualité. En tant que distributeurs agréés pour Mellanox, Ruckus, Aruba et Extreme, nous stockons des commutateurs réseau d'origine, des solutions de cartes réseau (cartes NIC), des points d'accès sans fil, des contrôleurs et des câbles. Nous maintenons un inventaire de 10 millions de dollars pour garantir une exécution rapide sur diverses gammes de produits. Chaque expédition est vérifiée pour son exactitude, et nous fournissons une consultation et un support technique 24h/24 et 7j/7. Nos équipes commerciales et techniques professionnelles ont acquis une excellente réputation sur les marchés mondiaux : associez-vous à nous pour des solutions d'infrastructure fiables.